-

- [연구] 이상원 교수 연구실(VLDB), 2022년 SKKU대학원생 논문대상 우수상 수상

- 이상원 교수 연구실(VLDB), 2022년 SKKU대학원생 논문대상 우수상 수상 4단계 BK21 대학원혁신지원사업 세부추진과제의 일환으로 시행된 2022년 SKKU 대학원생 논문대상에서 우리대학 이상원 교수님 VLDB 연구실 소속 석사과정 이보현 학생이 우수상을 수상하였습니다. 본 사업의 이공학 분야 신청자는 총 113명으로 약 5:1의 경쟁률을 기록하였습니다. 높은 경쟁률을 뚫고 우수한 연구력을 바탕으로 선정된 이보현 학생의 수상을 진심으로 축하합니다.

-

- 작성일 2022-10-26

- 조회수 1377

-

- [연구] 이지형 교수 연구실, EMNLP 2022 논문 게재 승인

- 이지형 교수 연구실, EMNLP 2022 논문 게재 승인 정보 및 지능 시스템 연구실(지도교수: 이지형)의 최윤석(소프트웨어학과 박사과정)과 김효준(인공지능학과 석사과정)의 "TABS: Efficient Textual Adversarial Attack for Pre-trained NL Code Model Using Semantic Beam Search" 논문이 세계 최고 권위의 자연어처리분야 학회 'EMNLP(Empirical Methods in Natural Language Processing) 2022'에 게재 승인되었습니다. 2022년 12월 UAE 아부다비에서 발표될 예정입니다. YunSeok Choi, Hyojun Kim, and Jee-Hyong Lee. "TABS: Efficient Textual Adversarial Attack for Pre-trained NL Code Model Using Semantic Beam Search" In Proceedings of the 2022 Conference on Empirical Methods in Natural Language Processing: EMNLP 2022, Abu Dhabi, UAE, 2022 본 연구에서는 beam search 기반의 black-box adversarial attack method인 TABS를 제안합니다. 기존 연구는 간단한 greedy search 기반의 비효율적인 방법으로 adversarial example을 생성하지만, TABS는 beam search와 contextual semantic filtering를 통해 더 나은 adversarial example을 생성함과 동시에 search space를 효율적으로 줄이는 것을 확인하였습니다. 제안된 방법론은 NL code search classification과 retrieval task에서 attack success, the number of queires, semantic similarity 모두 향상된 성능을 달성하였습니다. Abstract: As pre-trained models have shown successful performance in program language processing as well as natural language processing, adversarial attacks on these models also attract attention. However, previous works on blackbox adversarial attacks generated adversarial examples in a very inefficient way with simple greedy search. They also failed to find out better adversarial examples because it was hard to reduce the search space without performance loss. In this paper, we propose TABS, an efficient beam search black-box adversarial attack method. We adopt beam search to find out better adversarial examples, and contextual semantic filtering to effectively reduce the search space. Contextual semantic filtering reduces the number of candidate adversarial words considering the surrounding context and the semantic similarity. Our proposed method shows good performance in terms of attack success rate, the number of queries, and semantic similarity in attacking models for two tasks: NL code search classification and retrieval tasks.

-

- 작성일 2022-10-25

- 조회수 1139

-

- [연구] 서의성 교수 연구실(CSL), 학부연구생 ICCD 학술대회 논문 발표

- 서의성 교수 연구실(CSL), 학부연구생 ICCD 학술대회 논문 발표 소프트웨어학과 학부 19학번 박소영 학생이 10월 23일 미국 Lake Tahoe에서 40년 역사의 우수학술대회인 IEEE International Conference on Computer Design (ICCD)에 주저자로 "Analysis and Mitigation of Data Sanitization Overhead in DAX File Systems" 논문 발표합니다. 박소영 학생의 논문은 Persistent media를 사용하는 저장장치의 성능을 활용하기 위한 Direct Access(DAX) 파일시스템들에서 공통적으로 발생하는 append write의 성능 저하 원인이 새로 할당된 데이터블록의 기존 데이터를 삭제하는 Zero-Out 과정에 있음을 밝히고, Zero-Out을 지연시간에 결정적인 쓰기 경로(write path)에서 분리하여, 백그라운드에서 진행하도록 운영체제의 구조를 개선하여 벤치마크 기준 36.8%의 append write 성능 향상을 얻었습니다.

-

- 작성일 2022-10-18

- 조회수 1359

-

- [연구] 김재광 교수 연구실(main Lab), IEEE ICDM 2022 논문 채택

- main Lab. (지도교수: 김재광)의 논문이 인공지능/데이터마이닝 분야 우수학회인 IEEE ICDM 2022 22nd IEEE International Conference on Data Mining의 Workshop (ML-HOS: Machine Learning on Higher- Order Structured data) 에 채택되었습니다. 논문은 22년 11월 미국 올란도에서 발표될 예정입니다. 논문 "Hybrid Oversampling Technique Based on Star Topology and Rejection Methodology for Classifying Imbalanced Data"은 이채규 (데이터사이언스융합학과) 연구원이 저자로 참여하였으며, 불균형 데이터 세트에서 분류 작업을 수행하고 분류를 개선하기 위해 소수 클래스에서 데이터를 오버샘플링하고 신뢰성이 낮은 생성 데이터를 reject 하는 새로운 기술을 제시하여 91개 데이터 셋에서 39개의 최신 방법들과 겨루어 우수한 성능을 보였습니다.

-

- 작성일 2022-10-11

- 조회수 1161

-

- [연구] 우홍욱 교수 연구실(CSI연구실), Neurips 2022 논문 게재 승인

- 우홍욱 교수 연구실(CSI연구실), Neurips 2022 논문 게재 승인 CSI연구실 (지도교수: 우홍욱)의 논문이 인공지능 분야 우수학회인 Neurips 2022 (Thirty-sixth Conference on Neural Information Processing systems) 에 게재 승인(Accept) 되었습니다. 논문은 22년 11월 미국 뉴올리언스에서 발표될 예정입니다. 논문 “Skills Regularized Task Decomposition for Multi-task Offline Reinforcement Learning” 은 유민종, 조상우 (소프트웨어학과 석박사통합과정) 연구원이 저자로 참여했으며, 오프라인 데이터셋을 활용하여 로봇, 드론 자율주행과 같은 복잡한 다중 태스크 학습에 샘플 효율적 적용이 가능한 공통 스킬 구축 기법을 제시합니다. CSI 연구실은 머신러닝, 강화학습, 자기지도학습 등을 활용하여 네트워크, 클라우드 시스템 최적화 연구와 로봇, 드론 자율주행 연구 등을 수행하고 있습니다. 이번 Neurips 2022 논문의 연구는 사람중심인공지능 핵심원천기술사업 (IITP), DNA+드론기술개발사업 (과기정통부), 삼성리서치 (삼성전자)의 지원으로 진행 중 입니다.

-

- 작성일 2022-09-19

- 조회수 1453

-

- [연구] 구형준 교수 연구실, ACSAC 2022 논문 2편 게재 승인

- SecAI 연구실 (지도교수: 구형준)의 논문 2편이 컴퓨터 보안 분야의 우수 학술대회인 ACSAC (Annual Computer Security Applications Conference)에 게재 승인되었습니다! [논문 #1] Practical Binary Code Similarity Detection with BERT-based Transferable Similarity Learning: BERT와 Siamese neural network 기반으로 Few shot learning의 장점을 활용한 바이너리 유사도 논문으로 주어진 코드 snippet을 비교할 때 distance 함수의 scalar 값이 아니라 distance 자체를 학습을 통해 vector로 학습해 유사성을 판정합니다. Abstract. Binary code similarity detection serves as a basis for a wide spectrum of applications, including software plagiarism, malware classification, and known vulnerability discovery. However, the inference of contextual meanings of a binary is challenging due to the absence of semantic information available in source codes. Recent advances leverage the benefits of a deep learning architecture into a better understanding of underlying code semantics and the advantages of the Siamese architecture into better code similarity detection. In this paper, we propose BinShot, a BERT-based similarity learning architecture that is highly transferable for effective binary code similarity detection. We tackle the problem of detecting code similarity with one-shot learning (a special case of few-shot learning). To this end, we adopt a weighted distance vector with a binary cross entropy as a loss function on top of BERT. With the prototype implementation of BinShot, our experimental results demonstrate the effectiveness, transferability, and practicality of BinShot, which is robust to detecting the similarity of previously unseen functions.We show that BinShot outperforms the previous state-of-the-art approaches for binary code similarity detection. [논문 #2] DeView: Confining Progressive Web Applications by Debloating Web API - 2020년 CCS에 발표한 Chromium debloating 논문(Slimium)의 후속작으로 Chromium 기반의 PWA (Progressive Web Application) debloating 연구입니다. 사용자 행위 등 동적 테스트를 통해 기록한 후 이를 재생하는 방식으로(record-and-replay) PWA에 사용하는 Web API를 프로파일링한 후, Web API 진입점만 제거해 가볍게 적용할 수 있도록 구현한 논문입니다. Abstract. A progressive web application (PWA) becomes an attractive option for building universal applications based on feature-rich web application programming interfaces (Web APIs). While flexible, such vast APIs inevitably bring a significant increase in an API attack surface, which commonly corresponds to a functionality that is neither needed nor wanted by the application. A promising approach to reduce the API attack surface is software debloating, a technique wherein an unused functionality is programmatically removed from an application or API. Unfortunately, debloating PWAs is challenging given the monolithic design and non-deterministic execution of a modern web browser. In this paper, we present DeView, a practical approach that reduces the attack surface of a PWA by blocking unnecessary but accessible web APIs. DeView tackles the challenges of PWA debloating by i) record-and-replay web API profiling that identifies needed web APIs on an app-by-app basis by replaying (recorded) browser interactions and ii) compiler-assisted browser debloating that eliminates the entry functions of corresponding web APIs from the mapping between web API and its entry point at a binary level. Our evaluation shows the effectiveness and practicality of DeView. DeView successfully eliminates 91.8% of accessible web APIs while i) maintaining original functionalities and ii) preventing 76.3% of known exploits on average.

-

- 작성일 2022-09-16

- 조회수 1094

-

- [연구] 우사이먼성일 교수 DASH 연구실, CIKM 2022 국제 학술대회 full paper 논문 5편 게재 승인

- DASH 연구실 신유진(SW학과), 박은주(SW학과), 이광한(AI학과), 이한빈(AI학과), 김정호(AI학과), 신새별(데이터사이언스 학부), Binh M. Le(SW학과), Chingis Oinar(SW학부)의 논문 5편이 full paper가 인공지능 및 정보검색 분야의 top-tier 국제학술대회인 CIKM (Conference on Information and Knowledge Management) 2022 (BK IF=3)에 최종 논문 게재가 승인되어 10월에 발표될 예정입니다. 항공우주연구원과 시계열 기반 괘도 예측 및 이상탐지 연구 (신유진, 박은주) Neural Networks Pruning 연구 (이광한 신새별) 미국 USC와 YouTube의 콘텐츠 Privacy 및 유해성 관련 탐지 모델 개발 연구(Binh M. Le, Chingis Oinar, 국제공동) 호주 CSIRO Data61과 시계열 데이터에 대한 Adversarial Attack 연구(Binh M. Le 국제공동) Self-Knowledge Distillation기법을 제안하여 다양한 비전 테스크 성능향상 연구 (이한빈, 김정호) Thanks to students who did exceptional work! Appreciate their efforts ! 1. Youjin Shin, Eun-Ju Park, Simon S. Woo, Okchul Jung and Daewon Chung, ”Selective Tensorized Multi-layer LSTM for Orbit Prediction”, Proceedings of the 31st ACM International Conference on Information & Knowledge Management. 2022. 본 연구에서는 위성의 궤도를 예측하는 모델로서 Selective Tensorized multi-layer LSTM (ST-LSTM)을 제안합니다. 최근, 위성의 수가 급격하게 늘어남에따라 위성 충돌 위험이 증가하였습니다. 이러한 위성 충돌과 같은 돌발상황을 막기 위해서는 위성의 궤도를 정확하게 예측하는 것이 중요합니다. ST-LSTM은 딥러닝의 웨이트 매트릭스를 텐서화한 tensorizing layer를 멀티레이어 LSTM에 선택적으로 적용합니다. 항공우주연구소 (KARI)에서 제공된 두 개의 실제 위성에 대한 데이터를 가지고 다양한 비교 모델들과 함께 실험한 결과, ST-LSTM은 계산량을 줄이면서도 정확도 또한 높게 유지하였습니다. Although the collision of space objects not only incurs a high cost but also threatens human life, the risk of collision between satellites has increased, as the number of satellites has rapidly grown due to the significant interests in many space applications. However, it is not trivial to monitor the behavior of the satellite in real-time since the communication between the ground station and spacecraft are dynamic and sparse, and there is an increased latency due to the long distance. Accordingly, it is strongly required to predict the orbit of a satellite to prevent unexpected contingencies such as a collision. Therefore, the real-time monitoring and accurate orbit prediction is required. Furthermore, it is necessarily to compress the prediction model, while achieving a high prediction performance in order to be deployable in the real systems. Although several machine learning and deep learning-based prediction approaches have been studied to address such issues, most of them have applied only basic machine learning models for orbit prediction without considering the size, running time, and complexity of the prediction model. In this research, we propose Selective Tensorized multi-layer LSTM (ST-LSTM) for orbit prediction, which not only improves the orbit prediction performance but also compresses the size of the model that can be applied in practical deployable scenarios. To evaluate our model, we use the real orbit dataset collected from the Korea Multi-Purpose Satellites (KOMPSAT-3 and KOMPSAT-3A) of the Korea Aerospace Research Institute (KARI) for 5 years. In addition, we compare our ST-LSTM to other machine learning-based regression models, LSTM, and basic tensorized LSTM models with regard to the prediction performance, model compression rate, and running time. 2. Gwanghan Lee, Saebyeol Shin, and Simon S. Woo, ”Accelerating CNN via Dynamic Pattern‑based Pruning Network”, Proceedings of the 31st ACM International Conference on Information & Knowledge Management. 2022. 본 연구에서는 실제 가속이 가능한 dynamic pruning method를 제안합니다. 기존의 dynamic pruning method는 매 인풋샘플마다 sparse pattern이 다르기에, 가속을 위해 수행되는 추가적인 오버헤드때문에 실제 가속까지 이루어지기 어려웠습니다. 본 논문에서는 이를 해결하기 위해 새로운 dynamic pruning method를 제안하며, convolution kernel의 representational power를 높여 성능을 높였을 뿐만 아니라 BLAS 라이브러리를 이용해 쉽게 가속이 이루어질 수 있게 만들었습니다. 이를 통해 CIFAR과 ImageNet 데이터셋에서 실험한 결과 기존의 SOTA 방법론에 비해 연산량 대비 정확도가 향상됨을 보였습니다. Most dynamic pruning methods fail to achieve actual acceleration due to the extra overheads caused by indexing and weight-copying to implement the dynamic sparse patterns for every input sample. To address this issue, we propose Dynamic Pattern-based Pruning Network, which preserves the advantages of both static and dynamic networks. Unlike previous dynamic pruning methods, our novel method dynamically fuses static kernel patterns, enhancing the kernel's representational power without additional overhead. Moreover, our dynamic sparse pattern enables an efficient process using BLAS libraries, accomplishing actual acceleration. We demonstrate the effectiveness of the proposed network on CIFAR and ImageNet, outperforming the state-of-the-art methods achieving better accuracy with lower computational cost. 3. Binh M. Le, Rajat Tandon, Chingis Oinar, Jeffrey Liu, Uma Durairaj, Jiani Guo, Spencer Zahabizadeh, Sanjana Ilango, Jeremy Tang, Fred Morstatter, Simon Woo and Jelena Mirkovic, ”Samba: Identifying Inappropriate Videos for Young Children on YouTube”, Proceedings of the 31st ACM International Conference on Information & Knowledge Management. 2022. 본 논문에서는 어린이용 유튜브 동영상을 분류하기위해 메타데이터와 비디오 자막을 모두 사용하는 Samba라는 퓨전 모델을 제안합니다. 기존 연구는 어린이들이 보기에 부적절한 비디오를 감지하기 위해 비디오 썸네일, 제목, 댓글 등과 같은 메타데이터를 활용했습니다. 이러한 메타데이터 기반 접근법은 높은 정확도를 달성하지만, 입력 feature의 신빙성으로 인해 상당한 오분류 결과를 가집니다. Self-supervised contrastive 프레임워크로 pre-train된, 자막에서의 representation feature를 추가함으로써, Samba 모델은 다른 SOTA 분류기보다 7% 이상 높은 성능을 보입니다. 또한 향후 연구를 장려하기 위해 7만여개의 영상도 함께 공개합니다. In this paper, we propose a fusion model, called Samba, which uses both metadata and video subtitles for content classifying YouTube videos for kids. Previous studies utilized metadata, such as video thumbnails, title, comments, ect., for detecting inappropriate videos for young viewers. Such metadata-based approaches achieve high accuracy but still have significant misclassifications due to the reliability of input features. By adding representation features from subtitles, which are pretrained with a self-supervised contrastive framework, our Samba model can outperform other state-of-the-art classifiers by at least 7%. We also publish a large-scale, comprehensive dataset of 70K videos for future studies. 4. Shahroz Tariq, Binh M. Le and Simon Woo, ”Towards an Awareness of Time Series Anomaly Detection Models' Adversarial Vulnerability”, Proceedings of the 31st ACM International Conference on Information & Knowledge Management. 2022. 본 연구에서는 시계열 데이터의 이상(anomaly) 검출기의 적대적 취약성에 대한 인식을 높이는 것을 목표로 하여, 센서 데이터에 약간의 적대적 섭동(adversarial perturbation)을 추가함에도 이상 감지 시스템이 심각하게 약화되는 것을 보입니다. 이상 현상(anomaly)에 대해 견고하며 실제 시스템에서 사용될 수 있다고 주장하는 SOTA 심층 신경망(DNN)과 그래프 신경망(GNN)의 성능이 FGSM(Fast Gradient Sign Method)과 PGD(Projected Gradient Descent)와 같이 잘 알려진 적대적 공격에서 0%로 떨어진다는 것을 보입니다. 우리가 아는 한, 본 연구는 적대적 공격에 대한 이상 감지 시스템의 취약성을 처음으로 입증하였습니다. Time series anomaly detection is studied in statistics, ecology, and computer science. Numerous time series anomaly detection strategies have been presented utilizing deep learning. Many of these methods exhibit state-of-the-art performance on benchmark datasets, giving the false impression that they are robust and deployable in a wide variety of real-world scenarios. In this study, we demonstrate that adding modest adversarial perturbations to sensor data severely weakens anomaly detection systems. Under well-known adversarial attacks such as Fast Gradient Sign Method (FGSM) and Projected Gradient Descent (PGD), we demonstrate that the performance of state-of-the-art deep neural networks (DNNs) and graph neural networks (GNNs), which claim to be robust against anomalies and possibly be used in real-world systems, drops to 0%. We demonstrate for the first time, to our knowledge, the vulnerability of anomaly detection systems to adversarial attacks. This study aims to increase awareness of the adversarial vulnerabilities of time series anomaly detectors. 5. Hanbeen Lee, Jeongho Kim and Simon Woo, “Sliding Cross Entropy for Self-Knowledge Distillation”, Proceedings of the 31st ACM International Conference on Information & Knowledge Management. 2022. 본 연구에서는 기존 self-knowledge distillation에 결합하여 성능을 향상시키는 Sliding Cross Entropy (SCE)를 제안합니다. Self-distillation을 위한 soft target과 모델의 output logit의 차이를 최소화하기 위하여, 정렬된 각 softmax representation을 특정 윈도우로 나누고, 나누어진 슬라이스끼리의 거리를 최소화합니다. 이를 통하여, 모델은 최적화 과정에서 soft target의 클래스간 관계를 동등하게 고려할 수 있습니다. 다양한 실험을 통하여 본 논문에서 제안하는 SCE가 분류, 객체 탐지, 세그멘테이션에서 기존 베이스라인 방법론을 뛰어넘는 성능을 보여줍니다. Knowledge distillation (KD) is a powerful technique for improving the performance of a small model by leveraging the knowledge of a larger model. Despite its remarkable performance boost, KD has a drawback with the substantial computational cost of pre-training larger models in advance. Recently, a method called self-knowledge distillation has emerged to improve the model's performance without any supervision. In this paper, we present a novel plug-in approach called Sliding Cross Entropy (SCE) method, which can be combined with existing self-knowledge distillation to significantly improve the performance. Specifically, to minimize the difference between the output of the model and the soft target obtained by self-distillation, we split each softmax representation by a certain window size, and reduce the distance between sliced parts. Through this approach, the model evenly considers all the inter-class relationships of a soft target during optimization. The extensive experiments show that our approach is effective in various tasks, including classification, object detection, and semantic segmentation. We also demonstrate SCE consistently outperforms existing baseline methods.

-

- 작성일 2022-08-25

- 조회수 1442

-

- [연구] 데이터 지능 및 학습 연구실(지도교수: 이종욱), SIGIR 2022 및 IJCAI 2022 논문 게재

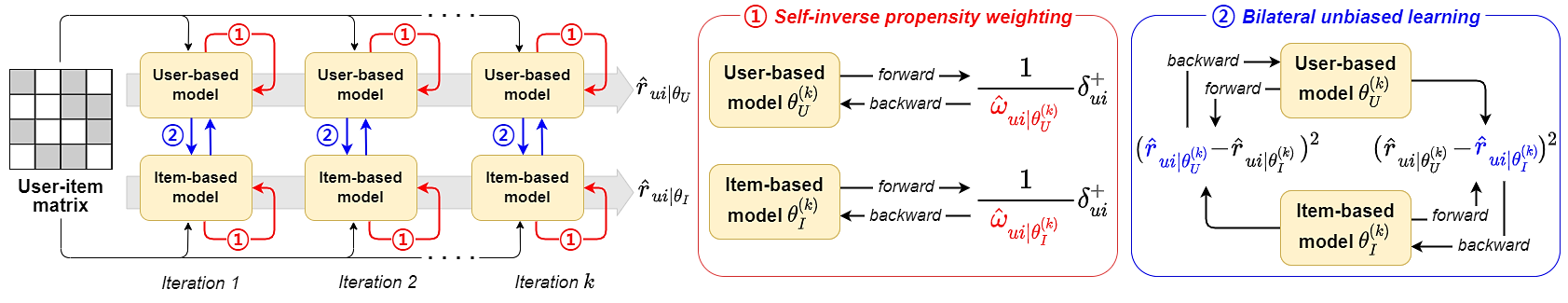

- 연구 1: Jae-woong Lee, Seongmin Park, Joonseok Lee, and Jongwuk Lee, “Bilateral Self-unbiased Learning from Biased Implicit Feedback”, 45th International ACM SIGIR Conference on Research and Development in Information Retrieval (SIGIR), 2022 연구 2: Duhyeon Bang, Kyungjune Baek, Jiwoo Kim, Yunho Jeon, Jin-Hwa Kim, Jiwon Kim, Jongwuk Lee, and Hyunjung Shim, “Logit Mixing Training for More Reliable and Accurate Prediction”, 31st International Joint Conference on Artificial Intelligence (IJCAI), 2022 연구 1: 데이터 지능 및 학습(Data Intelligence and Learning, DIAL) 연구실 소속 이재웅(박사과정, 제1저자) 학생, 박성민(석·박통합과정, 제2저자) 학생, 이종욱(교신저자) 교수와 이준석(구글 리서치/서울대, 제3저자) 교수가 연구한 “Bilateral Self-unbiased Learning from Biased Implicit Feedback” 논문이 세계 최고 권위 정보검색 학회인 SIGIR 2022에 full paper track으로 최종 게재 승인되었으며, 지난 7월 12일 스페인 마드리드에서 논문을 발표하였습니다. 이재웅(박사과정) 박성민(석·박통합과정) 본 연구는 편향되어 있는 추천 데이터에서 추천 모델을 학습할 때 모델에 존재하는 편향 문제를 완화하는 추천 모델을 제안하였습니다. 구체적으로, 추천 데이터의 편향을 제거하기 위해 두 가지로 요소를 개발하여 추천 모델의 편향 제거에 활용하였습니다. (1) 모델의 출력에 포함되어 있는 편향으로 모델의 편향을 제거하는 자기 역편향 가중치(Self-inverse propensity weighting)를 통해 학습 과정에서 데이터의 편향을 완화하는 방법과 (2) 두 가지 상호 보완적인 추천 모델인 사용자기반 추천 모델과 항목기반 추천 모델을 활용하여 추천 모델의 편향을 안정적으로 제거하기 위해 예측 결과의 오차를 줄이는 방법인 양방향 편향 제거 학습(Bilateral unbiased learning)을 고안하였습니다. 제안된 추천 모델은 실험적으로 효과적으로 추천 결과의 편향을 제거됨을 확인하였으며, 편향 제거 평가 시 일반적으로 사용되는 Coat 및 Yahoo! R3 데이터에서 기존의 편향 제거 모델 대비 추천 성능을 최대 15% 개선하였습니다. <그림 1: 사용자 기반 항목 기반 추천 모델을 활용하여 자기 역편향 가중치와 양방향 편향 제거 학습을 활용한 학습 과정> 연구 2: 데이터 지능 및 학습(Data Intelligence and Learning, DIAL) 연구실 소속 김지우(석사과정, 제3저자) 학생과 이종욱 교수와 카이스트 심현정 교수 연구팀이 공동 연구를 진행한 교수가 “Logit Mixing Training for More Reliable and Accurate Prediction” 논문이 세계 최고 권위 인공지능 학회인 IJCAI 2022에 full paper track으로 최종 게재 승인되었으며, 7월 23일에 연구 성과를 발표하였습니다. 김지우(석사과정) 본 연구는 사람이 객관식 문제를 풀 때, 무엇이 정답인지를 고려할 뿐 아니라 무엇이 정답이 아닌지를 모두 고려하는 사람의 정답 추론 과정에 영감을 받아, 정답 클래스와 오답 클래스 간 관계를 모두 활용한 LogitMix를 제안하였습니다. 구체적으로, 본 연구에서 제안한 LogitMix는 기존에 데이터 증강 방법인 Mixup, Manifold Mixup, CutMix 및 PuzzleMix와 같은 방법과 결합이 가능하며, 두 데이터 결합 시 로짓(Logit) 레벨에서 두 샘플을 효과적으로 결합하는 방법입니다. 이를 통해, 긍정적(정답) 클래스와 부정적(오답) 클래스 간 관계를 보존하여, 효과적으로 클래스의 확률 분포를 학습 과정에 규제화하여 학습할 수 있도록 하였습니다. 제안 방법은 이미지 및 언어 기반 분류 모델에 효과적으로 LogitMix를 적용하여 교정 오류 및 예측 정확도를 개선할 수 있음을 검증하였습니다. <그림: 2차원 나선형 데이에서 다양한 Mixup 기반의 학습 방법 적용시 분류 모델의 결정 평면에 대한 도식도, 제안 방법인 LogitMix가 다른 방법 대비 두 개의 클래스를 효과적으로 구분하고 있으며, 두 클래스간 확률 분포가 자연스럽게 변함을 확인됨>

-

- 작성일 2022-08-01

- 조회수 1192

-

- [연구] 허재필 교수 연구실, ECCV 2022 논문 2편 게재 승인

- 비주얼컴퓨팅연구실(지도교수: 허재필)의 논문 2편이 컴퓨터 비전 및 인공지능 분야의 Top-tier 학술대회인 European Conference on Computer Vision 2022에 게재 승인되었습니다. 논문 #1: “Tailoring Self-Supervision for Supervised Learning” (인공지능학과 석사과정 문원준, 인공지능학과 박사과정 김지환) 논문 #2: “Difficulty-Aware Simulator for Open Set Recognition” (인공지능학과 석사과정 문원준, 인공지능학과 석사과정 박준호, 인공지능학과 석박통합과정 성현석, 인공지능학과 석박통합과정 조철호) “Tailoring Self-Supervision for Supervised Learning” 논문에서는 먼저 Supervised Learning 환경에서 Self-supervision Task가 특별한 변경 없이 추가적으로 적용되었을 때, 발생할 수 있는 문제점들을 지적하였습니다. Supervised Learning의 Objective를 보조하는 역할로의 Self-supervision Task가 적용될 때, Self-supervision Task가 가져야 할 세 가지 특성을 제시하고, 이를 만족하는 Localization Rotation이라는 새로운 Task를 제안하였습니다. 제안한 방법이 Deep Learning 모델의 강건함 및 일반화 능력을 시험할 수 있는 여러 벤치마크에서 일관된 성능 향상을 가져오는 것을 확인하였습니다. “Difficulty-Aware Simulator for Open Set Recognition” 논문에서는 Open Set Recognition을 위한 가상의 샘플을 시뮬레이션 하는 새로운 방법을 제시하였습니다. Open Set Recognition 문제는 학습 때 경험하지 못한 새로운 클래스의 데이터를 식별하는 문제로, 인공지능을 실세계에 적용하기 위해 필수적인 요소 기술입니다. 기존의 방법들도 모델 학습 시 가상의 샘플들을 생성하여 활용하였지만, 본 논문에서는 기존 기술들이 다양한 난이도의 Open Set 샘플들에 대응하기 어렵다는 것을 확인하고, 다양한 난이도의 Open Set 샘플들을 시뮬레이션 하는 Difficulty-Aware Simulator 프레임워크를 제안하였습니다. 제안된 기술은 의도한대로 분류기의 입장에서 난이도별로 가상의 샘플을 만들어냈으며, 이를 활용하여 Open Set Recognition 분야에서 높은 성능을 달성하였습니다. [논문 #1 정보] Tailoring Self-Supervision for Supervised Learning WonJun Moon, Ji-Hwan Kim, and Jae-Pil Heo European Conference on Computer Vision (ECCV), 2022 Abstract: Recently, it is shown that deploying a proper self-supervision is a prospective way to enhance the performance of supervised learning. Yet, the benefits of self-supervision are not fully exploited as previous pretext tasks are specialized for unsupervised representation learning. To this end, we begin by presenting three desirable properties for such auxiliary tasks to assist the supervised objective. First, the tasks need to guide the model to learn rich features. Second, the transformations involved in the self-supervision should not significantly alter the training distribution. Third, the tasks are preferred to be light and generic for high applicability to prior arts. Subsequently, to show how existing pretext tasks can fulfill these and be tailored for supervised learning, we propose a simple auxiliary self-supervision task, predicting localizable rotation (LoRot). Our exhaustive experiments validate the merits of LoRot as a pretext task tailored for supervised learning in terms of robustness and generalization capability. [논문 #2 정보] Difficulty-Aware Simulator for Open Set Recognition WonJun Moon, Junho Park, Hyun Seok Seong, Cheol-Ho Cho, and Jae-Pil Heo European Conference on Computer Vision (ECCV), 2022 Abstract: Open set recognition (OSR) assumes unknown instances appear out of the blue at the inference time. The main challenge of OSR is that the response of models for unknowns is totally unpredictable. Furthermore, the diversity of open set makes it harder since instances have different difficulty levels. Therefore, we present a novel framework, DIfficulty-Aware Simulator (DIAS), that generates fakes with diverse difficulty levels to simulate the real world. We first investigate fakes from generative adversarial network (GAN) in the classifier's viewpoint and observe that these are not severely challenging. This leads us to define the criteria for difficulty by regarding samples generated with GANs having moderate-difficulty. To produce hard-difficulty examples, we introduce Copycat, imitating the behavior of the classifier. Furthermore, moderate- and easy-difficulty samples are also yielded by our modified GAN and Copycat, respectively. As a result, DIAS outperforms state-of-the-art methods with both metrics of AUROC and F-score.

-

- 작성일 2022-07-29

- 조회수 1183

-

- [연구] 고영중 교수 자연어처리연구실, SIGIR 2022 국제 학술대회 논문 2편 게재 승인

- 자연어처리연구실 허태훈 석사과정, 박충원 석사과정(이상 인공지능학과)의 논문 2편이 인공지능 및 정보검색 분야의 top-tier 국제 학술대회(BK21 CS IF=4)인 SIGIR (The 45th International ACM SIGIR Conference on Research and Development in Information Retrieval) 2022에 최종 논문 게재가 승인되어 7월에 발표될 예정입니다. 1. Choongwon Park, Youngjoong Ko, “QSG Transformer: Transformer with Query-Attentive Semantic Graph for Query-Focused Summarization”, Proceedings of the 45th International ACM SIGIR Conference on Research and Development in Information Retrieval (SIGIR 2022), July 2022. 본 연구에서는 문서에서 질의에 알맞는 요약문을 생성하는 ‘질의 기반 문서 요약’ 의 성능을 높이기 위한 새로운 기법을 제안합니다. 제안 기법은 질의와 문서의 단어들을 여러 자연어처리 기술을 이용해 연결하여 하나의 그래프로 구성하고, 이를 요약문을 생성하는 것에 사용합니다. 구성된 그래프를 질의 기반 문서 요약에 효율적으로 활용하기 위해 새로운 그래프 인공신경망을 제안하고, 이를 트랜스포머 모델에 붙여 사용합니다. 두 개의 데이터셋을 이용한 실험 결과, 제안 기법이 이전 연구들의 성능을 모두 앞서는 결과를 보였습니다. 2. Taehun Huh and Youngjoong Ko, "Lightweight Meta-Learning for Low-Resource Abstractive Summarization", Proceedings of the 45th International ACM SIGIR Conference on Research and Development in Information Retrieval (SIGIR 2022), July 2022 본 연구에서는 레이블 된 학습 데이터가 적은 상태인 ‘저 자원 생성 요약’의 성능을 높이기 위한 새로운 기법을 제안합니다. 제안 모델에서는 적은 데이터를 활용하여 해당 도메인에 빠르게 적응시키기 위해 메타러닝을 사용합니다. 또한, 학습 동안 기존 언어 모델에 추가되는 경량화 모듈만 학습 가능하게 하여 적은 데이터에 과적합 되는 문제를 해결합니다. 총 11개의 요약 데이터셋으로 실험한 결과, 기존 연구 보다 더 높은 Rouge 스코어 성능을 얻었습니다.

-

- 작성일 2022-06-14

- 조회수 1321

발전기금

발전기금