-

- [연구] 허재필 교수 연구실, CVPR 2023 논문 3편 게재 승인

- 비주얼컴퓨팅연구실(지도교수: 허재필)의 논문 3편이 컴퓨터 비전 및 인공지능 분야의 Top-tier 학술대회인 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR) 2023에 게재 승인되었습니다. 논문 #1: “Disentangled Representation Learning for Unsupervised Neural Quantization” (인공지능학과 박사과정 노해찬, 인공지능학과 박사과정 현상익, 인공지능학과 박사과정 정우진) 논문 #2: "Query-Dependent Video Representation for Moment Retrieval and Highlight Detection" (인공지능학과 박사과정 문원준*, 인공지능학과 박사과정 현상익*) (* 공동1저자) 논문 #3: “Leveraging Hidden Positives for Unsupervised Semantic Segmentation” (인공지능학과 석박통합과정 성현석, 인공지능학과 박사과정 문원준, 인공지능학과 박사과정 이수빈) “Disentangled Representation Learning for Unsupervised Neural Quantization”에서는 비지도 양자화(unsupervised neural quantization)모델에서 역색인 구조(inverted file system)의 차벡터 인코딩(residual vector encoding)을 적용할 수 없다는 문제를 확인하였으며, 이를 해결하기 위해 새로운 네트워크 모듈을 제안하였습니다. 역색인 구조의 군집 센터(cluster center)의 정보를 네트워크의 잠재공간(latent space)에서 분리(disentangle)하여 양자화 코드북(quantization codebook)에 차벡터에 해당하는 정보만이 담기도록 설계하였습니다. 본 연구에서 제안된 네트워크는 비지도 양자화 분야의 기존 방법들을 크게 상회하는 성능을 달성하였습니다. "Query-Dependent Video Representation for Moment Retrieval and Highlight Detection " 논문에서는 비디오에서 사용자가 원하는 부분을 요약하고, 하이라이트 영상을 취득하는 문제를 다루고 있습니다. 구체적으로, 사용자가 원하는 부분은 문자 즉 텍스트로 입력을 받게 되는데 기존 최신 모델 구조인 트랜스포머 구조를 사용하는 논문들에서는 텍스트의 중요성을 크게 다루지 않고 있다는 문제를 제기하였습니다. 이러한 문제를 해결하기 위해, 해당 논문에서는 크게 세 가지 방법을 제안하고 있습니다. 먼저, cross-attention 구조를 인코딩 앞 단에 도입하여 비디오 추출 과정에서 텍스트 정보가 미치는 영향을 키워주었고, 텍스트와 비디오 사이에 연관성을 더 잘 학습하기 위해 거짓 텍스트-비디오 페어를 추가적으로 학습하였습니다. 또한, 모든 텍스트-비디오 페어는 각기 다른 정보를 다루고 있기에 하이라이트를 예측하는 예측기를 주어진 입력에 따라 변화하여 입력-의존적인 예측기를 사용하고자 하였습니다. 총 세 가지 데이터셋을 사용하여 실험하였고, 사용자 요청에 알맞은 영상을 추출하는 것과 하이라이트를 추출하는 두 가지 문제에서 모두 일관된 성능 향상을 가져오는 것을 확인하였습니다. “Leveraging Hidden Positives for Unsupervised Semantic Segmentation” 논문에서는 Unsupervised Semantic Segmentation를 위해 숨겨진 양성 샘플(hidden positive)을 찾아내 학습에 활용하는 새로운 방법을 제시하였습니다. 클래스 정보가 주어지지 않는 학습 상황에서 활용할 수 있을 만한 양성 샘플을 Global Hidden Positive(GHP)와 Local Hidden Positive(LHP)라는 두 가지 유형으로 정의하고, 이를 이용한 contrastive loss 설계와 그래디언트 전파(gradient propagation) 학습 전략으로 풍부한 의미 정보를 지역적 일관성을 유지하며 학습하였습니다. 이와 더불어 pretrained Vision Transformer(ViT)가 task-agnostic하다는 문제를 지적하여, 학습이 진행됨에 따라 좋은 quality를 가지게 되는 task-specific한 semantic information을 GHP를 정의하기 위한 추가적인 정보로 활용하였습니다. 제안된 기술은 Unsupervised Semantic Segmentation 분야에서 높은 성능을 달성하였습니다. [논문 #1 정보] Disentangled Representation Learning for Unsupervised Neural Quantization Haechan Noh, Sangeek Hyun, Woojin Jeong, Hanshin Lim, and Jae-Pil Heo IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), 2023 Abstract: The inverted index is a widely used data structure to avoid the infeasible exhaustive search. It accelerates retrieval significantly by splitting the database into multiple disjoint sets and restricts distance computation to a small fraction of the database. Moreover, it even improves search quality by allowing quantizers to exploit the compact distribution of residual vector space. However, we firstly point out a problem that an existing deep learning-based quantizer hardly benefits from the residual vector space, unlike conventional shallow quantizers. To cope with this problem, we introduce a novel disentangled representation learning for unsupervised neural quantization. Similar to the concept of residual vector space, the proposed method enables more compact latent space by disentangling information of the inverted index from the vectors. Experimental results on large-scale datasets confirm that our method outperforms the state-of-the-art retrieval systems by a large margin. [논문 #2 정보] Query-Dependent Video Representation for Moment Retrieval and Highlight Detection WonJun Moon, Sangeek Hyun, SangUk Park, Dongchan Park, and Jae-Pil Heo IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), 2023 Abstract: Recently, video moment retrieval and highlight detection~(MR/HD) are being spotlighted as the demand for video understanding is drastically increased. The key objective of MR/HD is to localize the moment and estimate clip-wise accordance level, i.e., saliency score, to the given text query. Although the recent transformer-based models brought some advances, we found that these methods do not fully exploit the information of a given query. For example, the relevance between text query and video contents is sometimes neglected when predicting the moment and its saliency. To tackle this issue, we introduce Query-Dependent DETR~(QD-DETR), a detection transformer tailored for MR/HD. As we observe the insignificant role of a given query in transformer architectures, our encoding module starts with cross-attention layers to explicitly inject the context of text query into video representation. Then, to enhance the model's capability of exploiting the query information, we manipulate the video-query pairs to produce irrelevant pairs. Such negative~(irrelevant) video-query pairs are trained to yield low saliency scores, which in turn, encourages the model to estimate precise accordance between query-video pairs. Lastly, we present an input-adaptive saliency predictor which adaptively defines the criterion of saliency scores for the given video-query pairs. Our extensive studies verify the importance of building the query-dependent representation for MR/HD. Specifically, QD-DETR outperforms state-of-the-art methods on QVHighlights, TVSum, and Charades-STA datasets. [논문 #3 정보] Leveraging Hidden Positives for Unsupervised Semantic Segmentation Hyun Seok Seong, WonJun Moon, SuBeen Lee, and Jae-Pil Heo IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), 2023 Abstract Dramatic demand for manpower to label pixel-level annotations triggered the advent of unsupervised semantic segmentation. Although the recent work employing the vision transformer (ViT) backbone shows exceptional performance, there is still a lack of consideration for task-specific training guidance and local semantic consistency. To tackle these issues, we leverage contrastive learning by excavating hidden positives to learn rich semantic relationships and ensure semantic consistency in local regions. Specifically, we first discover two types of global hidden positives, task-agnostic and task-specific ones for each anchor based on the feature similarities defined by a fixed pre-trained backbone and a segmentation head-in-training, respectively. A gradual increase in the contribution of the latter induces the model to capture task-specific semantic features. In addition, we introduce a gradient propagation strategy to learn semantic consistency between adjacent patches, under the inherent premise that nearby patches are highly likely to possess the same semantics. Specifically, we add the loss propagating to local hidden positives, semantically similar nearby patches, in proportion to the predefined similarity scores. With these training schemes, our proposed method achieves new state-of-the-art (SOTA) results in COCO-stuff, Cityscapes, and Potsdam-3 datasets. 허재필 | jaepilheo@skku.edu | 비주얼컴퓨팅 Lab | https://sites.google.com/site/vclabskku/

-

- 작성일 2023-04-24

- 조회수 1258

-

- [연구] 우사이먼성일 교수 연구실(DASH Lab) 2023 ACM SAC Best Paper 수상

- 우사이먼성일 교수 연구실(DASH Lab) 2023 ACM SAC Best Paper 수상 우사이먼성일 교수 연구실 (DASH Lab)의 김정호 (인공지능학과 석사 졸업), 김태준 (소프트웨어학과 융합보안트랙 석사과정) 학생들과 강북삼성병원 혈액종양내과 이윤규 교수, 영상의학과 함수연 교수의 “MGCMA: Multi-scale Generator with Channel-wise Mask Attention to generate Synthetic Contrast-enhanced Chest Computed Tomography” 논문이 The 38th ACM/SIGAPP Symposium on Applied Computing (SAC) 2023에서 Best Paper로 선정되었습니다. 일반적으로 CT촬영시 사용되는 조영제는 혈관의 대조도를 높여 조직이나 혈관의 병변을 명확하게 구별해 내는데 도움을 주는 의약품으로 사용됩니다. 하지만 신체에 투여되는 약물이기 때문에 과민반응 또는 신독성 부작용, 갑상성중독증, 폐부종, 혈전 등의 부작용을 유발할 수 있습니다. 이에 따라 본 연구에서는 CT 조영제 없이 촬영된 CT스캔 이미지로부터, 조영제를 투여한 CT스캔이미지를 생성하는 인공지능 네트워크인 Multi-scale Generator with Channel-wise Mask Attention (MGCMA)를 제안합니다. 본 연구에서 제안된 MGCMA 네트워크는 생성 네트워크인 Generative Adversarial Network (GAN)에 다중 스케일 특징을 고려하는 모듈을 접목시킴으로써 복잡한 의료 CT 이미지의 혈관의 대비를 효과적으로 증강시킬 수 있습니다. 또한, CT 조영증강 전 이미지와 증강 후 이미지의 쌍을 맞추는 것이 현실적으로 매우 어렵기 때문에, 쌍을 맞추지 않고도 image-to-image translation이 가능하도록 하는 CycleGAN Loss를 사용하여 효율적인 학습 파이프라인을 구성하였습니다. 본 모델을 학습 및 평가하기 위해 강북삼성병원으로부터 총 76,486장의 조영증강 전 이미지와 67,640장의 조영증강 후 이미지를 제공받았으며, PSNR, SSIM, MS-SSIM, FID, LPIPS의 5가지 평가 지표 사용하였고, 모든 지표에서 최신 모델의 성능을 능가하였습니다. 논문명: MGCMA: Multi-scale Generator with Channel-wise Mask Attention to generate Synthetic Contrast-enhanced Chest Computed Tomography 초록: Medical images, including computed tomography (CT) assist doctors and physicians in diagnosing anatomic structures and various internal pathologies. In CT, intravenous contrast media is often applied, which are chemicals developed to aid in the characterization of pathology by enhancing the capabilities of an imaging modality to differentiate between different biological tissues. Especially, with the use of contrast media, thorough examinations of the patients can be possible. However, contrast media can have severe adverse and side effects such as hypersensitive reaction to generalized seizures. Yet, without contrast media, it is difficult to diagnose patients that have disorders in the internal organs. With the help of DNN models, especially generative adversarial network (GAN), contrast-enhanced CT (CECT) images can be synthetically generated from non-contrast CT (NCCT) images. GANs or autoencoder-based models have been proposed to generate contrastenhanced CT images; however, the synthesized image does not fully reflect and have crucial spots where contrast has not been synthesized. Thus, in order to enhance the quality of the CECT image, we propose MGCMA, a multi-scale generator with a channel-wise mask attention module for generating synthetic CECT images from NCCT images. Our extensive experiments demonstrate that our model outperforms other baseline models in various metrics such as SSIM and LPIPS. Also, generated images from our approach achieve plausible outcomes from the domain experts’ (e.g., physicians and radiologists) evaluations. <그림 1. 최신 모델과의 정성적/정량적 성능 비교> <그림 2. Best Paper Award> 우사이먼성일 | swoo@skku.edu | 데이터기반 융합 보안 (DASH) Lab | http://dash.skku.edu/

-

- 작성일 2023-04-24

- 조회수 973

-

- [연구] 김재광 교수 연구실(main Lab), SIGIR 2023 국제 학술 대회 논문 채택

- main Lab. (지도교수: 김재광)의 논문 “How Important is Periodical Model update in Recommender System?” 이 세계 최고 권위 정보검색(Information Retrieval) 학회인 SIGIR 2023 (The 46th International ACM SIGIR Conference on Research and Development in Information Retrieval), the Perspective paper track에 채택되었습니다. 논문은 23년 7월 대만 타이페이에서 발표될 예정입니다. 본 논문은 카카오 추천팀과 협력한 연구로 추천시스템에서 주기적인 모델 업데이트의 중요성에 대한 온/오프라인 분석을 하여 특정 관점에서 의미있는 결과들을 도출하였습니다. 본 연구에는 성균관대학교 전기전자컴퓨터공학과의 석사과정 이동준 학생이 공동저자로 참여하였고, 김재광 교수가 교신저자로 참여하였습니다. [논문] H. Lee, S. Yoo, D. Lee, and J. Kim, “How Important is Periodical Model update in Recommender System?,” In Proceedings of 46th International ACM SIGIR Conference on Research and Development in Information Retrieval (SIGIR 2023), July 2023. [Abstract] In real-world recommender model deployments, the models are typically retrained and deployed repeatedly. It is the rule-of-thumb to periodically retrain recommender models to capture up-to-date user behavior and item trends. However, the harm caused by delayed model updates has not been investigated extensively yet. in this perspective paper, we formulate the delayed model update problem and quantitatively demonstrate the delayed model update actually harms the model performance by increasing the number of cold users and cold items increase and decreasing overall model performances. These effects vary across different domains having different characteristics. Upon these findings, we further argue that although the delayed model update has negative effects on online recommender model deployment, yet it has not gathered enough attention from research communities. We argue our verification of the relationship between the model update cycle and model performance calls for further research such as faster model training, and more efficient data pipelines to keep the model more up-to-date with the latest user behaviors and item trends.

-

- 작성일 2023-04-24

- 조회수 945

-

- [연구] 이지형 교수 연구실, SIGIR 2023 국제 학술대회 게재 승인

- 정보 및 지능 시스템 연구(지도교수: 이지형)의 양희윤(인공지능학과 석사과정), 최윤석(소프트웨어학과 박사과정), 김가형(인공지능학과 석사과정)의 “LOAM: Improving Long-tail Session-based Recommendation via Niche Walk Augmentation and Tail Session Mixup” 논문이 인공지능 및 정보검색 분야의 Top-tier 국제학술대회 (BK21 CS IF=4)인 SIGIR(The 46th International ACM SIGIR Conference on Research and Development in Information Retrieval) 2023에 최종 논문 게재가 승인되어 7월에 발표될 예정입니다. 본 연구에서는 추천 시스템 연구 분야 중 하나인 세션 기반 추천 시스템에서 데이터셋의 롱테일 분포로 인해 발생하는 롱테일 샘플의 추천 성능 저하 문제를 해결하기 위해 두 가지 증강기법을 제안합니다. 데이터셋의 특성인 순차성과 함께 등장하는 아이템(Sequential, item co-occurrence)등을 고려하여 기존의 학습 샘플들과 유사하면서도 다양성이 있는 증강샘플을 생성하기 위해 세션들로 이루어진 그래프를 순회하는 입력 데이터 증강 기법, NWA(Niche Walk Augmentation)를 제안합니다. 또한, 모델의 다양한 아이템 예측과 일반화(generalization)를 위해 세션의 특성(representation)을 추출한 뒤에 mixup 기반의 증강을 한 번 더 진행하였습니다. 실험 결과, 기존 제안되었던 세션 기반 추천 모델에 증강 기법을 함께 사용했을 때, 전체 샘플에 추천 정확도 저하를 최소화하면서 다양성을 향상시켰고, 롱테일 샘플에 대해 향상된 정확도와 다양성을 달성하였습니다. [논문] Heeyoon Yang, YunSeok Choi, Gahyung Kim, and Jee-Hyong Lee. “ LOAM: Improving Long-tail Session-based Recommendation via Niche Walk Augmentation and Tail Session Mixup”, In Proceedings of 46th International ACM SIGIR Conference on Research and Development in Information Retrieval (SIGIR 2023), July 2023. [Abstract] Session-based recommendation aims to predict the user’s next action based on anonymous sessions without using side information. Most of the real-world session datasets are sparse and have long-tail item distribution. Although long-tail item recommendation plays a crucial role in improving user satisfaction, only a few methods have been proposed to take the long-tail session recommendation into consideration. Previous works in handling data sparsity problems are mostly limited to self-supervised learning techniques with heuristic augmentation which can ruin the original characteristic of session datasets, sequential and co-occurrences, and make noisier short sessions by dropping items and cropping sequences. We propose a novel method, LOAM, improving LOng-tail session-based recommendation via niche walk Augmentation and tail session Mixup, that alleviates popularity bias and enhances long-tail recommendation performance. LOAM consists of two modules, Niche Walk Augmentation (NWA) and Tail Session Mixup (TSM). NWA can generate synthetic sessions considering long-tail distribution which are likely to be found in original datasets, unlike previous heuristic methods, and expose a recommender model to various item transitions with global information. This improves the item coverage of recommendations. TSM makes the model more generalized and robust by interpolating sessions at the representation level. It encourages the recommender system to predict niche items with more diversity and relevance. We conduct extensive experiments with four real-world datasets and verify that our methods greatly improve tail performance while balancing overall performance. 이지형 | john@skku.edu | 정보및지능시스템 Lab | http://iislab.skku.ac.kr/

-

- 작성일 2023-04-24

- 조회수 844

-

- [연구] 박호건 교수 연구실(기계학습, 데이터마이닝 연구실)의 추천 시스템 연구The Web Conference (WWW) 2023 논문 게재 승인

- 박호건 교수 연구실(기계학습, 데이터마이닝 연구실)의 추천 시스템 연구The Web Conference (WWW) 2023 논문 게재 승인. LearnData Lab(기계학습/데이터마이닝) 연구실(지도교수: 박호건, https://learndatalab.github.io)의정희수학생(석사과정)과박호건교수(교신저자)가제출한“Dual Policy Learning for Aggregation Optimization in Graph Neural Network-based Recommender Systems”논문이웹/데이터마이닝분야최우수학회 The Web Conference(WWW) 2023 (https://www2023.thewebconf.org) (BK IF=4)에게재승인되었고, 2023년 5월미국텍사스에서발표될예정입니다. 본논문은대부분의최신추천시스템의근간이되는그래프신경망(Graph neural networks; GNN)기반딥러닝모델에서사용가능한강화학습기반성능개선학습방법을제안합니다. 기존GNN 기반추천시스템은멀리떨어진이웃의정보를집계하여사용자와항목간의복잡한고차원적연결성을포착하는장점이있지만, 사용자와추천상품의이질적인특성으로인해성능향상에한계가있었습니다. 본논문에서는추천시스템을위한새로운강화학습기반메시지전달프레임워크인 DPAO(Dual Policy learning framework for Aggregation Optimization)를제안하며, 이중정책학습을사용하여사용자및상품에대한고차연결을적응적으로결정합니다. 제안한프레임워크는 Amazon, Yelp 포함 6개의실제상품추천데이터세트에서평가하였습니다. 그결과본논문이제안한프레임워크가최근발표된 GNN기반추천시스템모델을크게향상시켜, 대표적인추천시스템평가지표인nDCG와 Recall에서각각최대 63.7%와 42.9%까지향상시키는것으로나타났습니다. 구현코드와논문은본연구실홈페이지(https://learndatalab.github.io)에서확인할수있습니다. [논문정보] Heesoo Jung, Sangpil Kim, Hogun Park. Dual Policy Learning for Aggregation Optimization in Recommender Systems, In Proceedings of the ACM 32nd Web Conference: WWW 2023, Austin, USA, 2023. [Abstract] Graph Neural Networks (GNNs) provide powerful representations for recommendation tasks. GNN-based recommendation systems capture the complex high-order connectivity between users and items by aggregating information from distant neighbors and can improve the performance of recommender systems. Recently, Knowledge Graphs (KGs) have also been incorporated into the user-item interaction graph to provide more abundant contextual information; they are exploited to address cold-start problems and enable more explainable aggregation in GNN-based recommender systems (GNN-Rs). However, due to the heterogeneous nature of users and items, developing an effective aggregation strategy that works across multiple GNN-Rs, such as LightGCN and KGAT, remains a challenge. In this paper, we propose a novel reinforcement learning-based message passing framework for recommender systems, which we call DPAO (Dual Policy learning framework for Aggregation Optimization). This framework adaptively determines high-order connectivity to aggregate users and items using dual policy learning. Dual policy learning leverages two Deep-Q-Network models to exploit the user- and item-aware feedback from a GNN-R and boost the performance of the target GNN-R. Our proposed framework was evaluated with both non-KG-based and KG-based GNN-R models on six real-world datasets, and their results show that our proposed framework significantly enhances the recent base model, improving nDCG and Recall by up to 63.7% and 42.9%, respectively.

-

- 작성일 2023-02-23

- 조회수 1344

-

- [연구] 고영중 교수 자연어처리연구실, WSDM 2023 국제 학술대회 논문 게재 승인

- 고영중 교수 자연어처리연구실, WSDM 2023 국제 학술대회 논문 게재 승인 자연어처리연구실 박선영 석사과정(인공지능학과), 최규리, 유하은 석사과정(소프트웨어학과)의 “Never Too Late to Learn: Regularizing Gender Bias in Coreference Resolution” 논문이 웹 정보 검색 및 데이터 마이닝 분야의 top-tier 국제 학술대회(BK21 CS IF=3)인 WSDM (The 16th ACM International Conference on Web Search and Data Mining) 2023에 최종 논문 게재가 승인되어 2월에 발표될 예정입니다. 본 연구에서는 자연어 이해 태스크 중 하나인 상호 참조 해결로 언어 모델이 학습한 성 고정관념(stereotype)과 편향성(skew)을 완화하고 분석합니다. 사전학습 언어모델은 사전학습 과정에서 언어 이해 능력을 학습할 뿐만 아니라 대용량 코퍼스에 내재된 고정관념과 편향성 역시 학습합니다. 언어모델의 성 편견을 완화하고자 하는 기존 방법들은 편향성 문제 해결에 초점을 맞추고, 고정관념 학습 문제를 해결하지 못하거나 기존 사전학습 언어모델의 언어 이해 능력을 저하시키는 문제 등이 있었습니다. 본 논문에서는 이를 해결하기 위해 고정관념 중화(stereotype neutralization) 기법과 탄력적 변수 강화(elastic weight consolidation) 기법을 제시합니다. 대명사 참조 데이터셋을 이용한 실험 결과, 제안 기법이 사전학습 언어 모델의 성 고정관념과 편향성 문제를 효과적으로 해결한 것을 확인할 수 있었습니다. [논문] Sunyoung Park, Kyuri Choi, Haeun Yu, Youngjoong Ko, “Never Too Late to Learn: Regularizing Gender Bias in Coreference Resolution.”, Proceedings of the 16th ACM International Conference on Web Search and Data Mining (WSDM 2022), February 2023. Abstract: Leveraging pre-trained language models (PLMs) as initializers for efficient transfer learning has become a universal approach for text-related tasks. However, the models not only learn the language understanding abilities but also reproduce prejudices for certain groups in the datasets used for pre-training. Recent studies show that the biased knowledge acquired from the datasets affects the model predictions on downstream tasks. In this paper, we mitigate and analyze the gender biases in PLMs with coreference resolution, which is one of the natural language understanding (NLU) tasks. PLMs exhibit two types of gender biases: stereotype and skew. The primary causes for the biases are the imbalanced datasets with more male examples and the stereotypical examples on gender roles. While previous studies mainly focused on the skew problem, we aim to mitigate both gender biases in PLMs while maintaining the model's original linguistic capabilities. Our method employs two regularization terms, Stereotype Neutralization (SN) and Elastic Weight Consolidation (EWC). The models trained with the methods show to be neutralized and reduce the biases significantly on the WinoBias dataset compared to the public BERT. We also invented a new gender bias quantification metric called the Stereotype Quantification (SQ) score. In addition to the metrics, embedding visualizations were used to interpret how our methods have successfully debiased the models.

-

- 작성일 2023-02-22

- 조회수 1236

-

- [연구] 이상원 교수/남범석 교수 공동연구팀, VLDB 2023 국제학술대회 논문 게재 승인

- 이상원 교수/남범석 교수 공동연구팀, VLDB 2023 국제학술대회 논문 게재 승인 VLDB 연구실(지도교수: 이상원)의 안미진, 박종혁 (공동 1저자, 소프트웨어플랫폼학과 22년 8월 박사졸업) DICL 연구실 (지도교수: 남범석)의 남범석 교수가 공동연구 진행한 “NV-SQL: Boosting OLTP Performance with Non-Volatile DIMMs" 논문이 49th International Conference on Very Large Data Bases (VLDB)에 게재 승인되었습니다. VLDB는 데이터베이스 분야의 Top-tier 학술대회이며, 캐나다 밴쿠버에서 개최됩니다. 본 연구에서는 NVDIMM (Non-Volatile DIMM)을 DRAM과 같은 계층에서 쓰기 캐시로 도입하여 SSD 쓰기의 상당 부분을 흡수하는 새로운 데이터베이스 아키텍처인 NV-SQL을 제안합니다. NV-SQL은 두가지 기술적 의의를 가집니다. 첫째, 소량의 NVDIMM을 효율적으로 활용하기 위해, LSN으로 도출된 재업데이트 간격 기반 캐싱 기반 정책을 제안하였습니다. 페이지 접근 빈도 정보를 페이지 LSN으로만 도출할 수 있다는 점에서 참신합니다. 둘째, NVDIMM 캐싱 페이지가 충돌 시 페이지 작업 일관성을 위반할 수 있음을 발견하고 페이지별 업데이트 플래그를 사용하여 일치하지 않는 페이지를 감지하는 방법과 리두 로그를 사용하여 이를 수정하는 방법을 제안하였습니다. NV-SQL을 MySQL/InnoDB엔진에 구현하여, 쓰기 집약적인 OLTP 벤치마크를 활용한 성능평가를 수행한 결과, 트랜잭션 처리량 측면에서 DRAM이 더 큰 동일한 가격의 바닐라 MySQL보다 약 6.5배 더 뛰어남을 확인하였습니다. 이는 NV-SQL이 소량의 NVDIMM으로 SSD쓰기를 줄여 트랜잭션 처리량 성능을 높일 수 있음을 보여줍니다. https://vldb.org/2023/?review-board

-

- 작성일 2023-02-10

- 조회수 1150

-

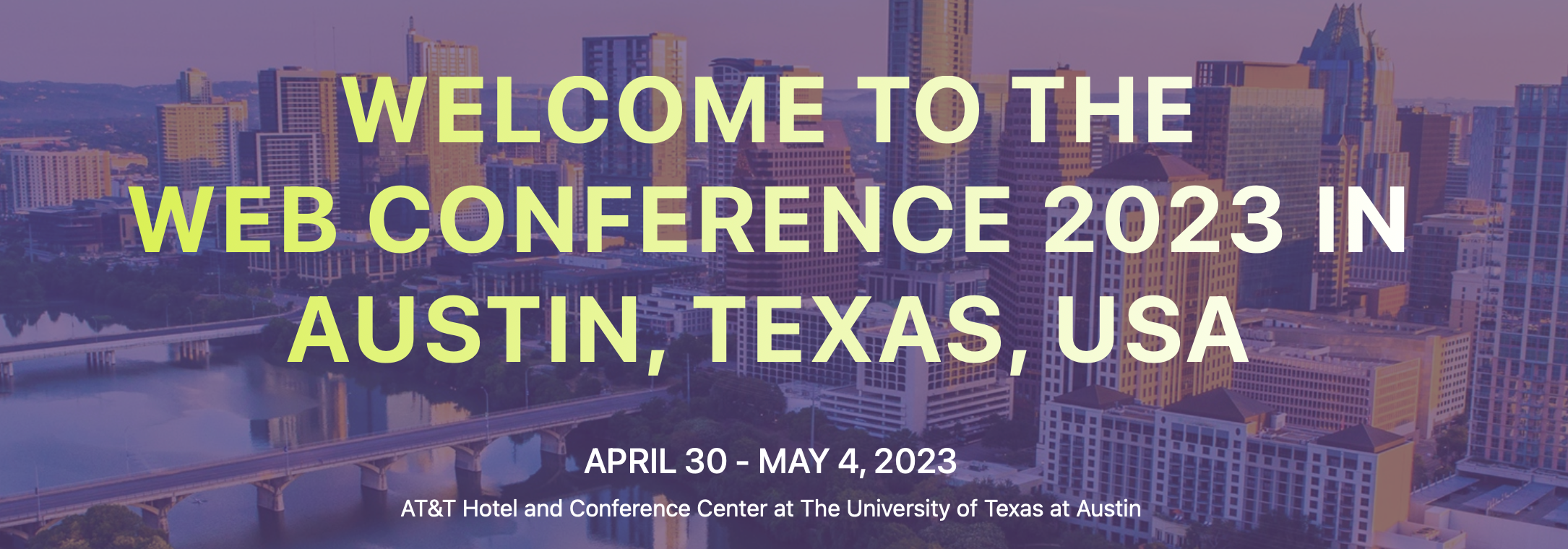

- [연구] 보안공학 연구실, The Web Conference (WWW) 2023 논문 게재 승인

- 보안공학 연구실, The Web Conference (WWW) 2023 논문 게재 승인 보안공학 연구실(지도교수: 김형식, https://seclab.skku.edu)의 오상학 학생(박사과정)과 김형식 교수(교신저자)가 진행한 “AppSniffer: Towards Robust Mobile App Fingerprinting Against VPN” 논문이 웹/데이터 마이닝 분야 최우수 학회 The Web Conference (WWW) 2023 (https://www2023.thewebconf.org) (BK IF=4)에 게재 승인되었고, 2023년 4월 미국 텍사스에서 발표될 예정입니다. 본 논문은 기존 모바일 앱 핑거프린팅 시스템들이 VPN 기술을 통해 쉽게 우회될 수 있는 한계점을 실험을 통해 제시하고, 이를 보완하기 위해 새로운 모바일 앱 핑거프린팅 시스템인 AppSniffer를 제안합니다. AppSniffer는 모바일 앱 트래픽이 VPN 환경에서 생성되었더라도 이를 분석하여 특징점을 추출하고, 앙상블 모델링을 통해 최종적으로 모바일 앱 핑거프린팅을 수행할 수 있도록 설계되었습니다. 본 논문에서는 100개의 모바일 앱 트래픽을 일반 환경과 VPN 환경에서 수집하였고, 이를 기반으로 실험을 통해 AppSniffer가 모든 환경(일반/VPN 환경)에서 모바일 앱 핑거프린팅을 수행할 수 있음을 보임으로써 VPN traffic에 robust함을 보여주었습니다. [논문 정보] Sanghak Oh, Minwook Lee, Hyunwoo Lee, Elisa Bertino, and Hyoungshick Kim. AppSniffer: Towards Robust Mobile App Fingerprinting Against VPN” In Proceedings of the ACM 32nd Web Conference: WWW 2023, Austin, USA, 2023 Abstract: Application fingerprinting is a useful data analysis technique for network administrators, marketing agencies, and security analysts. For example, an administrator can adopt application fingerprinting techniques to determine whether a user's network access is allowed. Several mobile application fingerprinting techniques (e.g., Flowprint, AppScanner, and ET-BERT) were recently introduced to identify applications using the characteristics of network traffic. However, we find that the performance of the existing mobile application fingerprinting systems significantly degrades when a virtual private network (VPN) is used. To address such a shortcoming, we propose a framework dubbed AppSniffer that uses a two-stage classification process for mobile app fingerprinting. In the first stage, we distinguish VPN traffic from normal traffic; in the second stage, we use the optimal model for each traffic type. Specifically, we propose a stacked ensemble model using Light Gradient Boosting Machine (LightGBM) and a FastAI library-based neural network model to identify applications' traffic when a VPN is used. To show the feasibility of AppSniffer, we evaluate the detection accuracy of AppSniffer for 100 popularly used Android apps. Our experimental results show that AppSniffer effectively identifies mobile applications over VPNs with F1-scores between 80.71% and 92.66% across four different VPN protocols. In contrast, the best state-of-the-art method (i.e., AppScanner) demonstrates significantly lower F1-scores between 31.69% and 48.22% in the same settings. Overall, when normal traffic and VPN traffic are mixed, AppSniffer achieves an F1-score of 88.52%, which is significantly better than AppScanner that shows an F1-score of 73.93%.

-

- 작성일 2023-01-30

- 조회수 1319

-

- [연구] 허재필 교수 연구실, AAAI 2023 논문 2편 게재 승인

- 비주얼컴퓨팅연구실(지도교수: 허재필)의 논문 2편이 인공지능 분야의 Top-tier 학술대회인 AAAI Conference on Artificial Intelligence 2023 (AAAI-23) 에 게재 승인되었습니다. 논문 #1: "Minority-Oriented Vicinity Expansion with Attentive Aggregation for Video Long-Tailed Recognition" (인공지능학과 박사과정 문원준, 인공지능학과 석박통합과정 성현석) 논문 #2: “Progressive Few-shot Adaption of Generative Model with Align-free Spatial Correlation” (DMC공학과 석사과정 문종보, 인공지능학과 석박통합과정 김현준, 공동1저자) "Minority-Oriented Vicinity Expansion with Attentive Aggregation for Video Long-Tailed Recognition" 논문에서는 비디오 데이터 취득할 때 발생하는 데이터 불균형 문제를 다루고 있습니다. 먼저, 데이터 불균형과 함께 비디오 분야에서 추가적으로 고려해야하는 문제점들을 먼저 제기하고 있는데 이는 1) 비디오 데이터에 대한 weak-supervision과 2) 기존의 비디오 데이터의 크기 때문에 사용하던 Pretrained Network가 다운 스트림 작업들에 적합하지 않다는 점입니다. 이를 보완하기 위해 해당 논문에서는 두가지 Attentive Aggregator를 도입하고, 데이터 불균형 문제를 해결하기 위해서는 데이터가 적은 클래스의 다양성을 증가시키는 변형된 외삽과 보간 기법을 제안합니다. 실험을 통해 제안된 방법이 여러 벤치마크에서 일관된 성능 향상을 가져오는 것은 물론, 새롭게 제안하는 벤치마크에서도 성능의 증가가 있음을 확인하였습니다. 추가로, 절제 연구를 통하여 데이터 불균형과 동시에 다루어야 한다고 주장한 두 가지 문제점의 대한 중요도도 실험으로 확인하였습니다. “Progressive Few-shot Adaption of Generative Model with Align-free Spatial Correlation” 논문에서는 매우 적은 수의 타겟 도메인 이미지만을 가지고 GANs 모델을 Adaptation하는 문제를 다루고 있습니다. 파인-튜닝과 같은 일반적인 방법을 사용하면 Mode-collapse에 취약하기 때문에 Source와 Target 모델이 각각 생성한 이미지들의 상대적인 거리를 유지하도록 학습하는 방법이 최근 연구되고 있지만, 1) 이미지의 전체 특징으로 거리를 측정하는 방식은 Source 모델이 갖는 세부적인 특징이 손실되고, 2) 이미지 패치단위 특징의 일관성을 유지하게 학습하는 방식은 Target 도메인의 구조적인 특성을 잃는 문제가 있습니다. 이를 보완하기 위해 해당 논문에서는 의미 있는 영역 간의 비교(예: 사람의 눈과 캐릭터의 눈 영역 비교)를 통해 Source 모델의 세부적인 특징을 보존하면서도 Target 도메인의 구조적인 특성을 반영하는 Adaptation을 목표로 1) Domain Gap을 줄여주는 Progressive Adaptation, 2) 의미 있는 영역 간의 비교를 위한 Align-free Spatial Correlation, 3) Importance Sampling 방식들을 제안하였습니다. 다양한 실험을 통해 제안한 방법이 정량적, 정성적 평가에서 우수한 성능을 나타내는 것으로 확인하였고, 특히 사람 평가에서도 좋은 결과를 보였습니다. [논문 #1 정보] Minority-Oriented Vicinity Expansion with Attentive Aggregation for Video Long-Tailed Recognition WonJun Moon, Hyun Seok Seong, and Jae-Pil Heo Thirty-Seventh AAAI Conference on Artificial Intelligence (AAAI), 2023 Abstract: A dramatic increase in real-world video volume with extremely diverse and emerging topics naturally forms a long-tailed video distribution in terms of their categories, and it spotlights the need for Video Long-Tailed Recognition (VLTR). In this work, we summarize the challenges in VLTR and explore how to overcome them. The challenges are: (1) it is impractical to re-train the whole model for high-quality features, (2) acquiring frame-wise labels requires extensive cost, and (3) long-tailed data triggers biased training. Yet, most existing works for VLTR unavoidably utilize image-level features extracted from pretrained models which are task-irrelevant, and learn by video-level labels. Therefore, to deal with such (1) task-irrelevant features and (2) video-level labels, we introduce two complementary learnable feature aggregators. Learnable layers in each aggregator are to produce task-relevant representations, and each aggregator is to assemble the snippet-wise knowledge into a video representative. Then, we propose Minority-Oriented Vicinity Expansion (MOVE) that explicitly leverages the class frequency into approximating the vicinity distributions to alleviate (3) biased training. By combining these solutions, our approach achieves state-of-the-art results on large-scale VideoLT and synthetically induced Imbalanced-MiniKinetics200. With VideoLT features from ResNet-50, it attains 18% and 58% relative improvements on head and tail classes over the previous state-of-the-art method, respectively. [논문 #2 정보] Progressive Few-shot Adaption of Generative Model with Align-free Spatial Correlation Jongbo Moon*, Hyunjun Kim*, and Jae-Pil Heo (*: equal contribution) Thirty-Seventh AAAI Conference on Artificial Intelligence (AAAI), 2023 Abstract: In few-shot generative model adaptation, the model for target domain is prone to the mode-collapse. Recent studies attempted to mitigate the problem by matching the relationship among samples generated from the same latent codes in source and target domains. The objective is further extended to image patch-level to transfer the spatial correlation within an instance. However, the patch-level approach assumes the consistency of spatial structure between source and target domains. For example, the positions of eyes in two domains are almost identical. Thus, it can bring visual artifacts if source and target domain images are not nicely aligned. In this paper, we propose a few-shot generative model adaptation method free from such assumption, based on a motivation that generative models are progressively adapting from the source domain to the target domain. Such progressive changes allow us to identify semantically coherent image regions between instances generated by models at a neighboring training iteration to consider the spatial correlation. We also propose an importance-based patch selection strategy to reduce the complexity of patch-level correlation matching. Our method shows the state-of-the-art few-shot domain adaptation performance in the qualitative and quantitative evaluations.

-

- 작성일 2023-01-25

- 조회수 1288

-

- [연구] 컴퓨터시스템 연구실 HPCA 2023 논문

- 제목: 컴퓨터시스템 연구실 (지도교수: 서의성) HPCA 2023 논문 컴퓨터시스템 연구실의 유준열, 김종석 박사과정과 서의성 교수는 클라우드에서 인공지능 서비스를 제공할 때, 서버, 가속장치, 그리고 인공지능 모델의 조합과 자원투입량에 따라 에너지 효율성이 크게 차이가 남을 발견하고, 이를 응용하여 기존 클라우드에서 인공지능을 서비스하는 GPU 서버가 소비하는 에너지를 20% 이상 절약할 수 있는 클라우드 플랫폼 자원 관리 기법을 개발하였습니다. 이상의 발견과 제안하는 기법은 "Know Your Enemy To Save Cloud Energy: Energy-Performance Characterization of Machine Learning Serving”이라는 제목으로 2월 25일 캐나다의 몬트리올에서 열리는 29회 IEEE International Symposium on High-Performance Computer Architecture (HPCA)에 발표될 예정입니다. HPCA는 컴퓨터 구조 및 시스템 분야에서 최고 수준의 학술대회이며, BK21+ 사업에서 가장 높은 등급(IF 4)을 인정 받고 있습니다. Abstract:The proportion of machine learning (ML) inference in modern cloud workloads is rapidly increasing, and graphic processing units (GPUs) are the most preferred computational accelerators for it. The massively parallel computing capability of GPUs is well-suited to the inference workloads but consumes more power than conventional CPUs. Therefore, GPU servers contribute significantly to the total power consumption of a data center. However, despite their heavy power consumption, GPU power management in cloud-scale has not yet been actively researched. In this paper, we reveal three findings about energy efficiency of ML inference clusters in the cloud. <1> GPUs of different architectures have comparative advantages in energy efficiency to each other for a set of ML models. <2> The energy efficiency of a GPU set may significantly vary depending on the number of active GPUs and their clock frequencies even when producing the same level of throughput. <3> The service level objective(SLO)-blind dynamic voltage and frequency scaling (DVFS) driver of commercial GPUs maintain an immoderately high clock frequency. Based on these implications, we propose a hierarchical GPU resource management approach for cloud-scale inference services. The proposed approach consists of energy-aware cluster allocation, intra-cluster node scaling, intra-node GPU scaling and GPU clock scaling schemes considering the inference service architecture hierarchy. We evaluated our approach with its prototype implementation and cloud-scale simulation. The evaluation with real-world traces showed that the proposed schemes can save up to 28.3\% of the cloud-scale energy consumption when serving five ML models with 105 servers having three different kinds of GPUs. 홈페이지: https://hpca-conf.org/2023/

-

- 작성일 2023-01-25

- 조회수 1152

발전기금

발전기금