-

- [연구] 우사이먼교수 (DASH) 연구실, 인공지능 그랜드 챌린지 2년 연속 수상 (1, 2, 3단계)

- 데이터 기반 융합 보안 연구실(DASH LAB, 지도교수: 우사이먼성일, 소프트웨어학과/융합보안트랙 안재주 석사과정, 인공지능학과 이한빈, 김정호, 김진범 석사과정)은 과학기술정보통신부가 주최하고 정보통신기획평가원이 주관하는 2021 인공지능 그랜드 챌린지 4차 3단계 대회 Track 1(행동인지)에서 1위를 수상하여 2년 연속 수상이라는 쾌거를 달성하였다. 인공지능 그랜드 챌린지 대회는 제시된 문제를 해결하기 위해 참가자들이 개발한 알고리즘을 가지고 실력을 겨루는 도전·경쟁형 연구개발(R&D) 경진대회이다. 이번 4차 3단계 대회는 ‘인공지능 기술을 활용하여 빠르고 정확하게 도움이 필요한 사람을 탐지하라’는 주제로 작년 11월 12일부터 동월 14일까지 온라인으로 진행되었다. 지난 2020년에 개최된 1단계 및 2단계 대회에서도 각각 1위, 3위의 성적을 거둔 데 이어 금번 대회에서도 1위의 성적을 거둬 과학기술정보통신부 장관상을 수상하였다. 본 대회에서는 제한된 컴퓨팅 파워에서 빠르고 정확하게 이상 행동을 보이는 사람을 탐지하는 것을 목표로 한다. 속도와 성능의 트레이드-오프를 극복하기 위해 본 연구실에서는 강력한 후처리 알고리즘을 사용하여 큰 모델로도 실시간 처리를 가능하도록 하였다. 더불어 최근 본 연구실에서 NeurIPS 2021 Datasets & Benchmarks Track에 발표한 VFP290K 데이터셋을 활용하여(VFP290K: A Large-Scale Benchmark Dataset for Vision-based Fallen Person Detection | OpenReview) 훈련된 모델은 본 챌린지에서도 뛰어난 성능을 보였다. 한편, DASH 연구실은 세계 최고 권위의 인공지능 학회인 AAAI, ICML, KDD, NeuralPS, WWW 및 CIKM 등에 논문이 게재되어 우수한 연구 성과를 지속해서 만들어내고 있다. 출처: http://www.aitimes.com/news/articleView.html?idxno=141936 https://www.yna.co.kr/view/AKR20211208151200017?input=1195m

-

- 작성일 2022-01-05

- 조회수 1159

-

- [연구] 이진규 교수, IEEE RTSS에 10년 연속 논문 게재

- 이진규 교수는 지난 12월 7일~12월 10일에 열린 IEEE RTSS (Real-Time Systems Symposium)에 아래의 논문을 교신저자로 게재 하였습니다. IEEE RTSS는 매년 30여편의 논문만이 발표되는 실시간 시스템 분야 Top 1 국제학술대회이며, 이진규 교수는 이로써 2012년부터 2021년 까지 10년 연속 IEEE RTSS에 논문을 게재하는 업적을 이루었습니다. (10년간 주저자 10편, 공저자 5편) http://2021.rtss.org/ [논문정보] - LaLaRAND: Flexible Layer-by-Layer CPU/GPU Scheduling for Real-Time DNN Task - Woosung Kang, Kilho Lee, Jinkyu Lee, Insik Shin and Hoon Sung Chwa - Deep neural networks (DNNs) have shown remarkable success in various machine-learning (ML) tasks useful for many safety-critical, real-time embedded systems. The foremost design goal for enabling DNN execution on real-time embedded systems is to provide worst-case timing guarantees with limited computing resources. Yet, the state-of-the-art ML frameworks hardly leverage heterogeneous computing resources (i.e., CPU, GPU) to improve the schedulability of real-time DNN tasks due to several factors, which include a coarse-grained resource allocation model (one-resource-per-task), the asymmetric nature of DNN execution on CPU and GPU, and lack of schedulabilityaware CPU/GPU allocation scheme. This paper presents, to the best of our knowledge, the first study of addressing the above three major barriers and examining their cooperative effect on schedulability improvement. In this paper, we propose LaLaRAND, a real-time layer-level DNN scheduling framework, that enables flexible CPU/GPU scheduling of individual DNN layers by tightly coupling CPU-friendly quantization with fine-grained CPU/GPU allocation schemes (one-resource-per-layer) while mitigating accuracy loss without compromising timing guarantees. We have implemented and evaluated LaLaRAND on top of the state-of-theart ML framework to demonstrate its effectiveness in making more DNN task sets schedulable by 56% and 80% over an existing approach and a baseline (vanilla PyTorch), respectively, with only up to -0.4% of performance (inference accuracy) difference.

-

- 작성일 2021-12-13

- 조회수 1260

-

- [연구] 차수영 교수, ICSE 2022 논문 게재 승인

- 소프트웨어학과 차수영 교수(제1저자)의 논문이 소프트웨어 공학 분야의 최상위 국제 학술대회인 ICSE 2022 (The 44th International Conference on Software Engineering)에 게재 승인되었습니다. 본 논문 “SymTuner: Maximizing the Power of Symbolic Execution by Adaptively Tuning External Parameters”은 2022년 5월 미국 피츠버그에서 발표될 예정입니다. 본 논문의 목표는 기호 실행(Symbolic Execution) 도구들의 수많은 외부 파라미터들을 사람의 개입 없이 자동으로 조정하는 것입니다. 이 목표를 달성하기 위해, 본 논문은 기호 실행기의 행동을 관찰하고 파라미터 값의 샘플링 확률을 적절히 업데이트해주는 학습 알고리즘을 제안했습니다. 그 결과, 본 연구는 최신 오픈-소스 C 프로젝트들에서 기존 기술들보다 더 높은 코드 커버리지와 많은 오류들을 검출하는데 성공했습니다. [논문 정보] - “SymTuner: Maximizing the Power of Symbolic Execution by Adaptively Tuning External Parameters” - Sooyoung Cha, Myungho Lee, Seokhyun Lee, and Hakjoo Oh - The 44th International Conference on Software Engineering (ICSE 2022) - Abstract: We present SymTuner, a novel technique to automatically tune external parameters of symbolic execution. Practical symbolic execution tools have important external parameters (e.g., symbolic arguments, seed input) that critically affect their performance. Due to the huge parameter space, however, manually customizing those parameters is notoriously difficult even for experts. As a consequence, symbolic execution tools have typically been used in a suboptimal manner that, for example, simply relies on the default parameter settings of the tools and loses the opportunity for better performance. In this paper, we aim to change this situation by automatically configuring symbolic execution parameters. With SymTuner that takes parameter spaces to be tuned, symbolic executors are run without manual parameter configurations; instead, appropriate parameter values are learned and adjusted during symbolic execution. To achieve this, we present a learning algorithm that observes the behavior of symbolic execution and accordingly updates the sampling probability of each parameter space. We evaluated SymTuner with KLEE on 12 open-source C programs. The results show that SymTuner increases branch coverage of KLEE by 55% on average and finds 8 more bugs than KLEE with its default parameters over the latest releases of the programs. 차수영 | sooyoung.cha@skku.edu | 소프트웨어 분석 연구실 | http://sal.skku.edu/

-

- 작성일 2021-12-08

- 조회수 1400

-

- [연구] 우사이먼 교수(DASH)연구실 AAAI2022 논문 1편 게재 승인

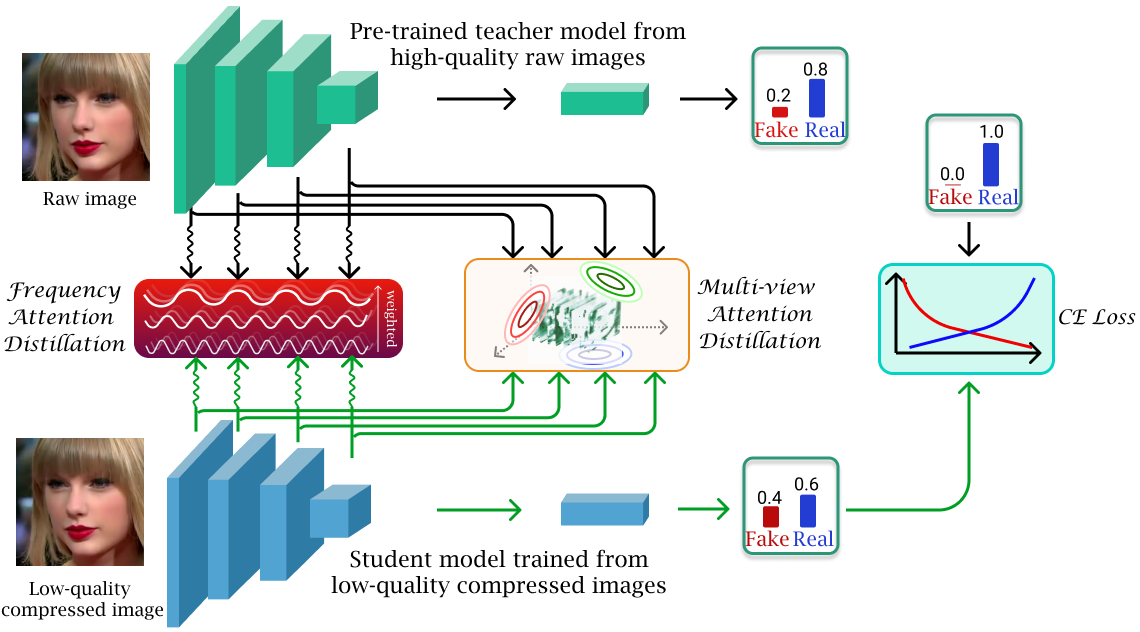

- Data-driven AI Security HCI(DASH Lab) 연구실 학생 Binh M. L(소프트웨어학과 석박과정연구원)과 우사이먼성일(교신저자)의 논문이 인공지능 최우수학회인 36th AAAI 2022(Acceptance Rate = 15%, BK IF= 4)에 최종 논문 게재가 승인되었고, 2022년 2월 캐나다 밴쿠버에서 발표될 예정입니다. 본 연구에서는 저화질(Low Quality)로 압축된 딥페이크 영상을 탐지하는 새로운 방법을 제안하였습니다. Optimal Transportation, Frequency Domain learning, Knowledge Distillation 이론을 활용하여 고화질 이미지에 대해 사전 훈련된 교사 (Teacher) 모델을 활용하여 저화질로 압축된 이미지를 감지하도록 학생 모델을 학습합니다. 세부적으로, 본 논문에서는 저화질의 딥페이크 탐지 모델에 두 가지 새로운 방법을 제안하였습니다. 첫 번째로 고주파 정보의 손실과 압축된 이미지의 상관관계 손실 정보를 활용합니다. 고도로 압축된 딥페이크를 탐지하기 위한 지식 증류(Knowledge Distillation) 프레임워크에서 주파수 어텐션 증류 (Frequency attention distillation) 및 다양한 데이터 뷰(view) 에서의 증류를 탐구하는 새로운 어텐션 기반 딥페이크 탐지 증류 방법을 제안했습니다. 주파수 어텐션은 학생 모델이 교사 모델로부터 고주파수 구성 요소를 검색하고 더 집중할 수 있도록 도와주는 역할을 하며 학습을 더욱 효율적으로 진행할 수 있습니다. 두 번째로 Sliced Wasserstein Distance을 활용한 멀티 뷰 어텐션은 학생 모델의 출력과 텐서 분포를 교사 모델에 활용하며, 이는 멀티 뷰의 텐서 요소 간 관련된 픽셀 특징들을 유지하는 역할을 합니다. 개발한 모델의 효율성을 검증하기 위해 본 논문에서는 다양한 벤치마크 데이터셋을 사용하고, 이전의 많은 최신 탐지 모델과 비교하였으며, 그중 가장 높은 성능을 확보할 수 있었습니다.

-

- 작성일 2021-12-07

- 조회수 1198

-

- [연구] CSI연구실 우홍욱 교수팀의 논문 2편이 AAAI 2022에 Accept

- CSI연구실 우홍욱 교수팀의 논문 2편이 AAAI 2022에 Accept CSI 연구실(지도교수: 우홍욱)의 논문 2편이 인공지능 분야 우수학회인 AAAI 2022 (36th AAAI Conference on Artificial Intelligence)에 게제 승인(Accept) 되었습니다. 두 논문은 22년 3월 캐나다 밴쿠버에서 발표될 예정입니다. 논문 “Structure Learning-Based Task Decomposition For Reinforcement Learning In Non-Stationary Environments” 은 유민종(소프트웨어학과 석박사통합과정) 연구원과 유광표(석사졸업) 연구원이 공동 1저자로 참여했으며, 동적 변화가 높은 가상물리 환경에서의 강건한 자율 에이전트 생성을 위한 Cycle-GAN 기반 다중 태스크 구조 학습 기법을 제시했습니다. 논문 “An Efficient Combinatorial Optimization Model Using Learning-to-Rank Distillation” 은 조상우 (석박사통합과정) 연구원과 이현성(석사졸업, 카카오) 연구원이 공동 1저자로 참여했으며, 조합 최적화 문제 해결을 위한 강화학습과 지식전이 기반의 저지연 추론 프레임워크를 제안했습니다. CSI (Computer System Intelligence 그룹) 연구실은 머신러닝을 활용하여 네트워크, 스토리지, 클라우드 시스템 최적화 연구와 드론 자율주행 연구 등을 수행하고 있습니다. 이번에 AAAI 2022에 Accept 된 두 논문의 연구는 ICT명품인재양성 사업, 딥러닝 고도화 핵심기술개발 사업(IITP), DNA+드론기술개발사업(과기정통부), 삼성전자의 지원으로 진행 중 입니다.

-

- 작성일 2021-12-06

- 조회수 1625

-

- [학생실적] 성균관대 소프트웨어융합대학 ThinkBoyz팀, 2021 SW인재페스티벌 대상 수상

- 성균관대학교(총장 신동렬) SW융합대학 ‘ThinkBoyz’팀이 12.2(목) 2021년 SW인재페스티벌 SW중심대학관 우수작품 시상식에서 과학기술정보통신부 장관상인 대상을 수상했다. SW인재페스티벌은 41개 SW중심대학 학생들이 SW·AI융합 산학 협력 프로젝트를 통해 개발한 우수 성과물을 선보이는 대회로, SW인재 양성의 중요성을 확산시키고 SW중심대학 사업과 대학교육 성과를 공유하기 위한 자리이다. ThinkBoyz팀은 ‘AI 기반 비대면 화상 학습 솔루션-ThinkBell’을 출품하여 대상을 거머쥐었다. 웅진씽크빅 에듀테크 기업의 산학과제로 결성된 본 팀은 COVID-19의 유행으로 오프라인(방문)학습이 어려워지면서, 비대면 화상 수업에서 나타나는 아이들의 수업 몰입도 저하에 따른 학습 효율과 솔루션을 제공하는 데 초점을 뒀다. SW융합대학 이은석 학장(SW중심대학사업단장 겸임)은 “디지털 대전환의 시대에 ThinkBoyz팀의 주요기술인 △딥러닝 기반 영상인식 △발화인식 △Gamification △AI Agent △ P2P 통신 등 비대면 화상 수업에서 수업 몰입도 향상을 위한 측정기술 개발은 SW· AI에 대한 자발적 참여와 흥미를 일으킬 수 있는 새로운 형태의 학습 플랫폼이다. 성균관대는 앞으로도 SW중심대학 사업의 가치와 성과들을 다른 공동체와 함께 나눌 수 있도록 더욱 최선을 다하겠다”고 말했다. 학생들을 지도한 박희선 교수는 “비대면 환경에서 어떻게 하면 아이들의 수업 몰입도를 이끌어내어, 수업 격차를 해소할 수 있을지 많이 고민한 과제였다. 학생들의 참신한 아이디어와 개발역량, 기술기반의 사회적 기여 그리고 화기애애했던 팀워크가 잘 합쳐져서 좋은 결과를 이루어낸 것 같아 기쁘다”고 말했다. ※ ThinkBioyz 팀(지도교수: 소프트웨어융합대학 박희선 교수 ) - 박성완 (소프트웨어학과) : 팀장, UI/UX Design & Gamification 개발 - 이진영 (소프트웨어학과) : 영상인식 기반 몰입도 측정 시스템 개발 - 최시열 (소프트웨어학과) : 영상인식 가능한 화상수업 시스템 개발 - 성효제 (소프트웨어학과) : 몰입도 향상 AI Agent 개발 - 이관우 (소프트웨어학과) : Front-end, 몰입도 향상 AI Agent 개발 출처 : 교수신문(http://www.kyosu.net)

-

- 작성일 2021-12-03

- 조회수 847

-

- [연구] 2021년 인공지능 그랜드 챌린지 5차 대회 입상

- 2021년 인공지능 그랜드 챌린지 5차 대회 입상 소프트웨어학과 데이터 지능 및 학습 연구실(Data Intelligence and Learning Lab, 지도 교수: 이종욱)이 “2021년 인공지능 그랜드 챌린지 5차 2단계 대회”에 참가하여 최종 선발되었습니다. 대회는 정보통신기획평가원(IITP) 주최로 진행되었으며, 총 34개 팀(228명)이 참가하여 최종 3개의 팀이 선발되었습니다. 선발된 팀에게는 3단계 대회 준비를 위한 4억7500만 원(총 14억2500억 원) 규모의 연구비가 지원됩니다. “인공지능 그랜드 챌린지” 대회는 제시된 문제를 해결하기 위해 참가자들이 개발한 학습 모델을 활용하여 실력을 겨루는 도전·경쟁형 연구개발(연구·개발 R&D) 경진대회입니다. 이번 5차 2단계 대회는 ‘인공지능 기술을 활용하여 텍스트로 구성된 서술형 수학 문제의 풀이 과정과 해답을 제시하라’는 주제로 10월 27일부터 29일까지 진행되었습니다. 수학 문장형 문제(Math Word Problem, MWP)는 자연어로 구성된 서술형 수학 문제에 대해서 수식 또는 프로그래밍 형태의 풀이 과정과 해답을 제시하는 학습 모델을 개발하는 것을 목표로 합니다. 이를 위해 학습 모델이 자연어 문장을 잘 이해할 수 있어야 함과 동시에 수학 문제를 효과적으로 풀기 위한 수식을 효과적으로 생성 및 추론할 수 있어야 합니다. 나아가, 학습한 모델이 인간처럼 여러 도메인의 지식을 받아들이고 이를 기반으로 서술형 문제의 맥락을 파악하여 수식의 답을 도출해내야 하므로 고도화된 인공지능 기술의 집약체라고 할 수 있습니다. 본 연구실은 지난 6월에 진행되었던 1단계 대회에서도 효과적으로 자연어 형태의 수학 문제를 이해할 수 있는 학습 모델을 개발하여 우수한 성적으로 입상하였습니다. 2단계 대회에서는 좀 더 복잡한 수학 문제를 풀 수 있도록 1단계의 모델을 고도화 및 추가적인 데이터를 수집을 통해 성능을 개선하였습니다. 관련 기사: https://www.inews24.com/view/1418957

-

- 작성일 2021-11-23

- 조회수 979

-

- [연구] 김유성 교수 연구실/ 스펙트럼 챌린지 대회 1등 수상

- 김유성 교수 연구실/ 스펙트럼 챌린지 대회 1등 수상 한국전자통신연구원(ETRI) 은 다양한 신규 무선 서비스가 상호 공존할 수 있게 하는 전파이용 핵심기술 연구·개발을 목표로 스펙트럼 챌린지 대회를 개최하였다. 전파이용률 향상 기술 분야로 '다중 주파수 채널 공유 네트워크 환경에서 강화학습을 활용한 효율적인 통신 방식 찾기'라는 주제로 8 대학 팀이 경연을 펼쳤으며, 성균관대학교 정신기 박사과정 , 박정인 학석 연계과정, 김유성 교수로 구성된 CSI Lab. (Computer Systems and Intelligence Lab) 팀이 1등을 수상하였다. CSI Lab. 은 2020년 스펙트럼 챌린지에서도 1등을 수상하여, 2년 연속 1등이라는 쾌거를 달성하였다. 스펙트럼 챌린지 대회는 4차 산업혁명과 초연결사회 구성의 핵심 자원인 주파수의 세계적 이용 패러다임 변화에 적극적으로 대응하고, 전파자원 이용 한계를 극복할 수 있는 핵심 기술 개발의 선봉 임무를 수행할 수 있는 기반이 될 것이며, 스펙트럼 챌린지를 통해 발굴된 기술과 연구개발 지원은 미래 수요가 급증할 것으로 예상하는 6㎓ 대역의 신규 공급과 6㎓대역 이용촉진에도 크게 기여할 수 있을 것으로 예상된다. 1등 수상 팀은 연구비 1억원를 지원 받는다. 기사 본문: https://www.news1.kr/articles/?4493568

-

- 작성일 2021-11-15

- 조회수 1071

-

- [연구] 우사이먼 교수(DASH) 연구실 NeurIPS 2021 국제학술대회 논문 2편 게재 승인

- Data-driven AI Security HCI 연구실(지도교수: 우사이먼성일)의 논문 2편이 인공지능 및 기계학습 분야 최우수 학회인 Neural Information Processing System (NeurIPS) 2021 (BK CS IF=4)의 Datasets and Benchmarks Track 에 게재 승인되었습니다. 논문 #1: “VFP290K: A Large-Scale Benchmark Dataset for Vision-based Fallen Person Detection” (공동 1저자: 소프트웨어학과 석사과정 안재주, 인공지능학과 석사과정 김정호, 그리고 인공지능학과 석사과정(이한빈, 김진범, 강준형), 소프트웨어학과 석사과정 김민하, 소프트웨어학과 학부과정(김민하, 홍동희, 신새별), 교신저자 우사이먼교수가 참여하였습니다. “VFP290K: A Large-Scale Benchmark Dataset for Vision-based Fallen Person Detection”에서는 쓰러진 사람을 이상 행동으로 정의하며, 이상 행동 탐지 모델 훈련에 필요한 대규모 데이터셋을 제안하였습니다. 기존 데이터셋의 문제점(특정 상황에 국한된 촬영, 단일 연기자 구성, 환경적 요소 제외, 적은 데이터 수량 등)을 해결하기 위해, 연구팀은 학교 근교를 포함한 길거리, 공원 및 건물 내부 등 49개의 장소에서 131장면을 실제 CCTV 환경을 재현하여 촬영하였습니다. 총 294,714장의 프레임으로 구성된 VFP290K 데이터셋은 광범위한 실험을 통해 기존 데이터셋 보다 데이터의 다양성과 일반화의 우수성을 증명하였으며, 2020년 진행된 인공지능 그랜드 챌린지 대회에서 1단계 1위 및 2단계 3위의 우수한 성적을 보임으로써, VFP290K 데이터셋의 유효성을 입증하였습니다. 논문 #1 요약 및 링크 VFP290K: A Large-Scale Benchmark Dataset for Vision-based Fallen Person Detection Jaeju An*, Jeongho Kim*, Hanbeen Lee, Jinbeom Kim, Junhyung Kang, Minha Kim, Saebyeol Shin, Minha Kim, Donghee Hong, Simon S. Woo Neural Information Processing System (NeurIPS) 2021 Datasets and Benchmarks Track 요약: Detection of fallen persons due to, for example, health problems, violence, or accidents, is a critical challenge. Accordingly, detection of these anomalous events is of paramount importance for a number of applications, including but not limited to CCTV surveillance, security, and health care. Given that many detection systems rely on a comprehensive dataset comprising fallen person images collected under diverse environments and in various situations is crucial. However, existing datasets are limited to only specific environmental conditions and lack diversity. To address the above challenges and help researchers develop more robust detection systems, we create a novel, large-scale dataset for the detection of fallen persons composed of fallen person images collected in various real-world scenarios, with the support of the South Korean government. Our Vision-based Fallen Person (VFP290K) dataset consists of 294,714 frames of fallen persons extracted from 178 videos, including 131 scenes in 49 locations. We empirically demonstrate the effectiveness of the features through extensive experiments analyzing the performance shift based on object detection models. In addition, we evaluate our VFP290K dataset with properly divided versions of our dataset by measuring the performance of fallen person detecting systems. We ranked first in the first round of the anomalous behavior recognition track of AI Grand Challenge 2020, South Korea, using our VFP290K dataset, which can be found here. Our achievement implies the usefulness of our dataset for research on fallen person detection, which can further extend to other applications, such as intelligent CCTV or monitoring systems. The data and more up-to-date information have been provided at our VFP290K site. 논문 #2: “FakeAVCeleb: A Novel Audio-Video Multimodal Deepfake Dataset” (제1저자 Hasam Khalid, 박사과정 Shahroz Tariq, 석사과정 김민하, 교신저자 우사이먼 (이상 소프트웨어학과)) “FakeAVCeleb: A Novel Audio-Video Multimodal Deepfake Dataset”에서는 딥페이크 비디오뿐만 아니라 립싱크 된 오디오를 포함하는 새로운 딥페이크 데이터셋을 제안하였습니다. 기존 딥페이크 데이터셋이 유니모달(Unimodal)에 근거한 단일 딥페이크 데이터셋이라는 한계를 해결하기 위해, 연구팀은 최근 가장 인기 있는 딥페이크 생성 방법과 오디오 생성 방법을 사용해 거의 완벽하게 립싱크 된 멀티모달(Multimodal) 딥페이크 데이터셋을 제작하였습니다. FakeAVCeleb은 인종적 편향성을 제거하기 위해 네 인종(백인, 흑인, 동부 아시아, 남부 아시아)의 비디오를 사용했습니다. 유니모달, 앙상블 추론 및 멀티모달 환경에서 다양한 최신 방법을 사용해 광범위한 실험을 진행했으며, 멀티모달 오디오-비디오 딥페이크 데이터셋의 유용성을 입증하였습니다. 논문 #2 링크 및 요약 FakeAVCeleb: A Novel Audio-Video Multimodal Deepfake Dataset Hasam Khalid, Shahroz Tariq, Minha Kim, Simon S. Woo Neural Information Processing System (NeurIPS) 2021 Datasets and Benchmarks Track 요약: While significant advancements have been made in the generation of deepfakes using deep learning technologies, its misuse is a well-known issue now. Deepfakes can cause severe security and privacy issues as they can be used to impersonate a person's identity in a video by replacing his/her face with another person's face. Recently, a new problem of generating synthesized human voice of a person is emerging, where AI-based deep learning models can synthesize any person's voice requiring just a few seconds of audio. With the emerging threat of impersonation attacks using deepfake audios and videos, a new generation of deepfake detectors is needed to focus on both video and audio collectively. A large amount of good quality datasets is typically required to capture the real-world scenarios to develop a competent deepfake detector. Existing deepfake datasets either contain deepfake videos or audios, which are racially biased as well. Hence, there is a crucial need for creating a good video as well as an audio deepfake dataset, which can be used to detect audio and video deepfake simultaneously. To fill this gap, we propose a novel Audio-Video Deepfake dataset (FakeAVCeleb) that contains not only deepfake videos but also respective synthesized lip-synced fake audios. We generate this dataset using the current most popular deepfake generation methods. We selected real YouTube videos of celebrities with four racial backgrounds (Caucasian, Black, East Asian, and South Asian) to develop a more realistic multimodal dataset that addresses racial bias, and further help develop multimodal deepfake detectors. We performed several experiments using state-of-the-art detection methods to evaluate our deepfake dataset and demonstrate the challenges and usefulness of our multimodal Audio-Video deepfake dataset. 위 논문들은 성균관대학교 소프트웨어학과와 인공지능학과 학생들의 협업과 노력으로 완성되었으며, 성균관대학교에서 독자적으로 추진한 연구로 본교 소프트웨어학과/인공지능학과의 우수성을 입증하였습니다.

-

- 작성일 2021-10-21

- 조회수 1236

-

- [연구] 엄영익 교수 연구실, 박종규 박사과정 SOSP 2021 국제학술대회 한국기관 최초 논문 게재

- 분산컴퓨팅연구실의 박종규 박사과정(지도교수 엄영익)이 ACM Symposium on Operating Systems Principles (SOSP) 2021에 “FragPicker: A New Defragmentation Tool for Modern Storage Devices” (저자: 박종규, 엄영익) 논문을 게재하였다. 본 논문은 기존 파일 시스템 단편화 제거 기법의 고질적인 문제점인 추가적인 쓰기 발생과 높은 소모 시간을 해결하기 위해 최신 스토리지 디바이스의 내부 특성을 고려한 새로운 단편화 제거 기법을 제안하는 논문이다. ACM SOSP는 격년으로 개최되는 운영체제 분야 최상위 학술대회로, 이번 SOSP 2021은 총 348편의 논문 중 54편(채택율 15.5%)의 논문이 채택되었다. 특히 본 건은 SOSP 학회 54년 역사상 한국 기관 최초의 논문이라는 데에 의미가 있다. [논문 정보] FragPicker: A New Defragmentation Tool for Modern Storage Devices Jonggyu Park and Young Ik Eom The 28th ACM Symposium on Operating Systems Principles (SOSP 2021) Abstract: File fragmentation has been widely studied for several decades because it negatively influences various I/O activities. To eliminate fragmentation, most defragmentation tools migrate the entire content of files into a new area. Unfortunately, such methods inevitably generate a large amount of I/Os in the process of data migration. For this reason, the conventional tools (i) cause defragmentation to be time-consuming, (ii) significantly degrade the performance of co-running applications, and (iii) even curtail the lifetime of modern storage devices. Consequently, the current usage of defragmentation is very limited although it is necessary. Our extensive experiments discover that, unlike HDDs, the performance degradation of modern storage devices incurred by fragmentation mainly stems from request splitting, where a single I/O request is split into multiple ones. With this insight, we propose a new defragmentation tool, FragPicker, to minimize the amount of I/Os induced by defragmentation, while significantly improving I/O performance. FragPicker analyzes the I/O activities of applications and migrates only those pieces of data that are crucial to the I/O performance, in order to mitigate the aforementioned problems of existing tools. Experimental results demonstrate that FragPicker efficiently reduces the amount of I/Os for defragmentation while achieving a similar level of performance improvement to the conventional defragmentation schemes.

-

- 작성일 2021-10-01

- 조회수 1720

발전기금

발전기금